Яндекс создал прототип закадрового перевода видео в браузере

Обновлено: 17.05.2024

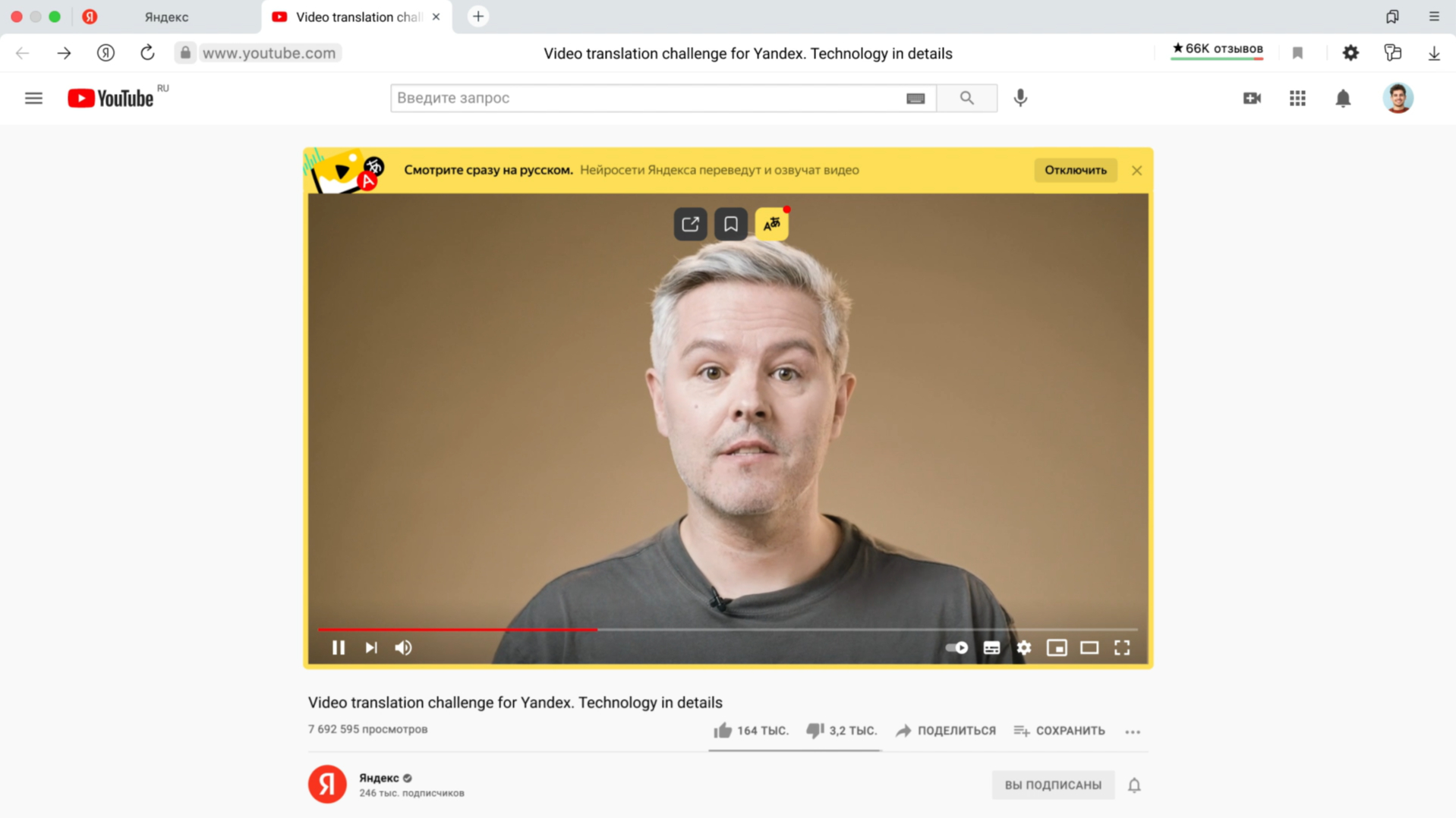

Этим летом Яндекс начал тестировать технологию машинного перевода видео. Чтобы показать, как она работает, мы перевели с её помощью несколько роликов и собрали их в плейлист . Сегодня — следующий шаг: мы открываем технологию для массового использования. Теперь вы можете посмотреть с русской озвучкой практически любой англоязычный ролик, какой захотите.

Перевод работает на компьютерах — в Яндекс.Браузере и на мобильных устройствах: в Браузере для Android и приложении Яндекс для Android и iOS .

Перевод, который выполняет Яндекс, получается закадровым и двухголосым. Мы приглушаем оригинальную звуковую дорожку — так, чтобы она была слышна, но не мешала восприятию — и накладываем на неё новую, с переводом. Мужские голоса переводятся мужским голосом, женские — женским. Если вы поймёте, что женский голос вам знаком, знайте, что вам не показалось. Это голос Алисы.

Переводить можно ролики, размещённые на YouTube, Vimeo и ещё нескольких популярных платформах. Главное, чтобы видео находилось в общем доступе.

Разработка видеоперевода шла почти год. В нём задействованы сразу несколько технологий Яндекса — в первую очередь это распознавание речи, синтез речи, биометрия и машинный перевод.

Как это работает

Процесс перевода состоит из нескольких этапов. Если у видеоролика нет субтитров, мы начинаем с того, что распознаём речь, то есть превращаем голос в текст. Если субтитры есть, мы смотрим на их происхождение. Субтитры, загруженные вручную, обычно хорошего качества — их можно брать в работу. Субтитры, сгенерированные автоматически, мы игнорируем и выполняем собственное распознавание. Получившийся текст «причёсывает» нейронная сеть. Она убирает мусор, например вставки вроде «звучит музыка», расставляет знаки препинания и распределяет слова по смысловым сегментам. Результат отправляется на перевод. Мы также сгружаем в систему перевода информацию о том, кто произносит ту или иную реплику: мужчина или женщина. От этого зависит не только выбор голоса, но и текст перевода. Мужчина будет говорить о себе в мужском роде, женщина в женском. Когда текст переведён, его нужно озвучить и совместить с видеорядом. Длина фраз на русском и английском языках отличается — русские, как правило, ощутимо длиннее. Здесь на помощь снова приходит нейронная сеть. Она выполняет то, что у синхронных переводчиков называется речевой компрессией: сокращает паузы между словами и, если необходимо, немного ускоряет темп речи. Подробнее о технологии перевода читайте в нашем блоге на « Хабре ».

С запуском закадрового перевода перед нашими пользователями открывается огромный пласт контента, который раньше был недоступен из-за языкового барьера. Лекции и документалки, стендапы и влоги, видеорецепты и пошаговые инструкции — всё это теперь можно смотреть на русском языке.

Мы не планируем останавливаться на достигнутом. В ближайших планах — освоить новые языковые пары и добавить в перевод больше голосов.

Яндекс объявил о работе над сервисом машинного перевода видео с одного языка на другой. Это позволит пользователям смотреть ролики в браузере с закадровым переводом. Прототип сервиса уже представлен, пока он переводит видео только с английского языка.

Как объяснили в компании, ее технология объединяет разработки «Яндекс.Переводчика», биометрии, распознавания и синтеза речи. Сервис машинного перевода сначала определяет пол говорящего, а затем подбирает соответствующий голос. Алгоритм отслеживает темп речи говорящего, за счет чего переводчик делает паузы, замедляет или ускоряет речь, чтобы закадровый голос совпадал с картинкой.

Перевод доступен в Яндекс.Браузере для Windows и macOS. Разработчики обещают, что скоро пользователи смогут выбирать, какие ролики переводить с помощью нового сервиса.

«В интернете очень много полезного контента, который недоступен людям из-за языкового барьера. И мы близки к тому, чтобы окончательно стереть все границы. Мы тоже в начале пути, но у нас уже есть прототип и понимание, куда двигаться дальше», — говорит руководитель направления обработки естественного языка в «Яндексе» Дэвид Талбот.

В 2017 году Яндекс начал задействовать технологии на искусственном интеллекте при переводе текстов. Тогда к статистической модели, которая была в «Переводчике» с момента запуска, добавили технологию перевода с помощью нейросети. Компания объясняла, что ее технология не разбивает текст на отдельные слова, а рассматривает его целиком, чтобы лучше передать смысл.

В июне Яндекс открыл доступ к нейросети «Балабоба» для всех пользователей. Она работает на языковой модели из семейства YaLM (Yet another Language Model). Эта модель помогает нейросети запоминать правила языка, выбирать подходящие слова и связывать их по смыслу. У «Балабобы» нет своего мнения, она выдает случайные продолжения и может закончить историю, придумать подпись или написать небольшой рассказ.

«Яндекс» работает над сервисом машинного перевода видео с одного языка на другой, который позволит пользователям смотреть ролики в браузере с закадровым переводом.

Компания представила прототип сервиса, он переводит видео только с английского языка.

Новая технология объединяет разработки «Яндекс.Переводчика», биометрии, распознавания и синтеза речи, сообщили в компании. Она определяет пол выступающего на видео и подбирает соответствующий голос. За темпом речи говорящего следит алгоритм, за счет чего переводчик делает паузы, замедляет или ускоряет речь, чтобы закадровый голос совпадал с картинкой.

Работа над сервисом продолжается, и вскоре пользователи смогут выбирать, какие ролики переводить с его помощью, пообещали в «Яндексе».

«В интернете очень много полезного контента, который недоступен людям из-за языкового барьера. И мы близки к тому, чтобы окончательно стереть все границы. <. > Мы тоже в начале пути, но у нас уже есть прототип и понимание, куда двигаться дальше», — заявил руководитель направления обработки естественного языка в «Яндексе» Дэвид Талбот.

В 2017 году «Яндекс» стал использовать искусственный интеллект при переводе текстов и начал работать по гибридной системе: к статистической модели, которая была в «Переводчике» с момента запуска, добавили технологию перевода с помощью нейросети. Как сообщили в компании, искусственный интеллект не разбивает текст на отдельные слова, а рассматривает целиком, что позволяет лучше передать смысл.

В конце июня сервис видеозвонков Zoom купил немецкий стартап Kites, который создает субтитры на других языках в режиме реального времени. Как заявили в Kites, технология, основанная на искусственном интеллекте, позволяет отображать стенограмму до того, как говорящий завершит предложение

«Яндекс» представил прототип машинного перевода в своем браузере: сейчас технология позволяет смотреть некоторые видео на английском языке с закадровым переводом на русский язык. Сотрудники «Яндекса» задумались о новой технологии осенью 2020 года, а к разработке приступили в начале 2021 года: в марте в компании появился первый рабочий прототип. Новая технология не имеет аналогов в мире, по данным компании, она объединила в себе машинный перевод, технологии биометрии, распознавания и синтеза речи. Пока полноценного продукта, который позволит переводить любое видео в интернете, у «Яндекса» нет, но компания до конца 2021 года будет добавлять в нее новые возможности — перевод видео по запросу, дополнительные функции и т. д.

Что это значит?

«Яндекс» создает продукты, которые используют десятки миллионов пользователей — например, «Браузер», «Карты», «Поиск» и т. д. Компания предоставляет их бесплатно, иногда показывает рекламу. «Яндекс» использует технологии в своих массовых продуктах, чтобы привлекать к ним новых пользователей.

Также востребованные технологии, которые создает «Яндекс», компания передает «Яндекс.Облаку», а это подразделение уже продает их корпоративным и бизнес-заказчикам, рассказал руководитель «Яндекс.Браузера» Роман Иванов. Например, «Яндекс.Облако» продает b2b-заказчикам технологии «Переводчика» или технологию распознавания и синтеза речи Yandex.SpeechKit. «Думаю, что технология перевода видео тоже будет востребована клиентами «Яндекс.Облака», — прогнозирует Иванов.

Зачем мне это знать?

Компании по всему миру развивают по отдельности технологии, которые «Яндекс» использовал в своем закадровом переводчике. У Google есть автоматически генерируемые субтитры в видео на YouTube, а в смартфонах на Android в настройках операционной системы можно включить функцию сопровождения автоматически сгенерированных субтитров для любого видео, которое воспроизводит гаджет.

Недавно американская компания Timekettle объявила сбор средств на краудфандинговой площадке Indiegogo для беспроводных наушников WT2 Edge с синхронным переводчиком на 40 языках и привлекла почти миллион евро. Пока неизвестно, отвечает ли продукт своему описанию, компания обещает представить его инвесторам в августе 2021 года.

В начале июля 2021 года разработчик под ником tgaru представил расширение для браузера YouTube SubSound, которое автоматически озвучивает субтитры на YouTube. Бесплатное расширение произносит субтитры, которые пользователь выбрал для видео, оно поддерживает русский, английский, японский, китайский, французский и другие языки.

Ведущая китайская компания в области искусственного интеллекта iFlytek выпускает в том числе портативные переводчики, которые могут, к примеру, переводить русскую речь в китайскую и обратно. Аналитики Goldman Sachs отмечают, что компания планирует достичь выручки в 100 млрд юаней ($15 млрд) к 2025 году по сравнению с 13 млрд юаней ($2 млрд) в 2020 году. Они также положительно оценивают возможности технологии искусственного интеллекта iFlytek на фоне их растущего проникновения в Китае.

Сложность создания технологии синхронного перевода видео в том, что процесс перевода поэтапный. Нужно распознать речь, перевести ее в текст, затем текст перевести на другой язык, а потом озвучить так, чтобы совпадал пол говорящего и длина озвучки. Иванов не исключает, что через некоторое время Google представит похожую технологию. «Нам просто повезло быть первыми», — добавил он.

Потребление видеоконтента продолжает расти по всему миру. Потенциально автоматический перевод и озвучивание видео могут быть очень востребованы у пользователей, особенно если «Яндекс» расширит базу доступных языков, считает аналитик ИК «ВЕЛЕС Капитал» Артем Михайлин. Если технология начнет пользоваться серьезным успехом, крупнейшие мировые IT-компании достаточно быстро создадут подобные же инструменты и внедрят их в свои ресурсы.

Помимо того, что для «Яндекса» запуск новой технологии — это имиджевая история, она станет для компании дополнительным инструментом для привлечения трафика. Новая функция может стать одним из факторов, который должен поддержать рост доли «Яндекс.Браузера» в России, считает аналитик Sova Capital Оксана Мустяца. Если в декабре 2020 года доля «Яндекс.Браузера» в России на всех устройствах составляла 19,5%, то в июне 2021 года она выросла до 20,2%. При этом браузер Google Chrome занимает более 40% рынка на протяжении уже четырех лет.

«Яндекс» создал технологию машинного перевода видео. С ее помощью видеоролики зарубежных авторов смогут посмотреть даже те, кто не владеет иностранными языками – разработка «Яндекса» в автоматическом режиме переведет видео на русский язык и озвучит его закадровым голосом. Об этом CNews рассказали представители компании. По заявлению создателей, технология не имеет аналогов в мире.

На сегодняшний день у «Яндекса» готов прототип системы машинного перевода. Сейчас он работает только с роликами на английском языке. Разработчики утверждают, что опробовали технологию на видеозаписях на самые разные темы: изменение климата, машинное обучение, история Плутона.

Пользователям функция машинного перевода видеороликов доступна в фирменном браузере «Яндекса» для операционных систем Windows и macOS, однако лишь при просмотре ограниченного числа роликов. Специалисты компании создали на Youtube-канале "Yet another browser" подборку из 12 видео (плейлист «Перевод видео»), с помощью которых любой желающий сможет убедиться в работоспособности технологии. В ближайшее время пользователи получат возможность самостоятельно выбирать, какие именно ролики переводить, обещают в «Яндексе».

«В интернете очень много полезного контента, который недоступен людям из-за языкового барьера, – говорит руководитель направления обработки естественного языка в «Яндексе» Дэвид Талбот (David Talbot). – И мы близки к тому, чтобы окончательно стереть все границы. "Яндекс.браузер" давно умеет переводить тексты, в этом году стал переводить изображения, перевод видео — следующий этап. Это большая сложная задача, которую никто в мире еще не решил. Мы тоже в начале пути, но у нас уже есть прототип и понимание, куда двигаться дальше»,

Как это работает

Над созданием прототипа работало несколько команд. Сейчас в нем применяются технология синтеза речи, разработки «Яндекс.переводчика» и биометрия. Последняя используется для определения пола говорящего – это, как отмечают в «Яндексе», важно и для перевода, и для синтеза речи, в частности, позволяет подобрать подходящий голос для закадровой озвучки.

Технология «Яндекса» поддерживает синхронизацию закадрового голоса с видеорядом, при необходимости корректируя темп речи виртуального переводчика и добавляя в нее паузы. Синхронизация необходима, поскольку исходные и переведенные реплики могут значительно отличаться по длительности – например, в английском языке часто используемые фразы нередко лаконичнее своих русских аналогов.

Эволюция «Яндекс.переводчика»

Сервис «Яндекс.переводчик» был запущен в 2011 г. На старте он мог работать с тремя языками: русским, украинским и английским. Сейчас он знает более 90 языков, включая экзотические, и может выполнять переводы между любой парой.

В 2016 г. «Переводчик» научился распознавать текст на картинках с помощью компьютерного зрения. В апреле 2021 г. «Яндекс» добавил соответствующую функцию в собственный браузер.

Российский конструктор криптовалют DecimalChain теперь совместим с Еthereum и Binance Smart Chain

В 2017 г. сервис начал использовать гибридную систему перевода. К статистической модели, которая задействована со старта, добавилась технология перевода на базе нейронной сети на основе архитектуры «трансформер».

Искусственный интеллект не разбивает переводимый текст на слова и выражения, как это делает статистический переводчик. Вместо этого он «проглатывает» предложение целиком и выдает перевод. Благодаря такому подходу в переводе учитывается контекст и лучше передается смысл, формулировки выглядят более естественно.

Статистическая модель, в свою очередь, хорошо справляется с редкими словами и фразами и не «фантазирует», если смысл предложения непонятен, как это может делать нейросеть.

Технология перевода с помощью нейронной сети, как ранее рассказывал «Яндекс», во многом послужила основой для YaTI – новой технологии анализа текста.

Как «Яндекс» применяет нейросети

Помимо «Переводчика», нейросети, к примеру, задействованы в работе поисковой системы «Яндекса». В основе обновления поисковика под кодовым названием Y1, о котором CNews писал в июне 2021 г., лежат YaTI и YaLM – глубокие нейросети с архитектурой «трансформер», обученные на огромном числе параметров.

В ноябре 2020 г. CNews писал о том, что поисковик «Яндекса» перешел на технологию анализа текста на основе нейросетей-трансформеров, в частности, YaTI. Это позволило ему лучше оценивать смысловую связь между запросами и содержанием интернет-документов. В компании сочли внедрение данной технологии важнейшим событием в развитии поисковой системы за последнее десятилетие.

Читайте также: