Как создать кластер серверов windows server 2012 r2 с нуля инструкция

Обновлено: 04.07.2024

Настраиваем отказоустойчивый кластер Hyper-V на базе Windows Server 2012

Уже на этапе планирования будущей виртуальной инфраструктуры следует задуматься об обеспечении высокой доступности ваших виртуальных машин. Если в обычной ситуации временная недоступность одного из серверов еще может быть приемлема, то в случае остановки хоста Hyper-V недоступной окажется значительная часть инфраструктуры. В связи с чем резко вырастает сложность администрирования - остановить или перезагрузить хост в рабочее время практически невозможно, а в случае отказа оборудования или программного сбоя получим ЧП уровня предприятия.

Все это способно серьезно охладить энтузиазм по поводу преимуществ виртуализации, но выход есть и заключается он в создании кластера высокой доступности. Мы уже упоминали о том, что термин "отказоустойчивый" не совсем корректен и поэтому сегодня все чаще используется другая характеристика, более точно отражающая положение дел - "высокодоступный".

Для создания полноценной отказоустойчивой системы требуется исключить любые точки отказа, что в большинстве случаев требует серьезных финансовых вложений. В тоже время большинство ситуаций допускает наличие некоторых точек отказа, если устранение последствий их отказа обойдется дешевле, чем вложение в инфраструктуру. Например, можно отказаться от недешевого отказоустойчивого хранилища в пользу двух недорогих серверов с достаточным числом корзин, один из которых настроен на холодный резерв, в случае отказа первого сервера просто переставляем диски и включаем второй.

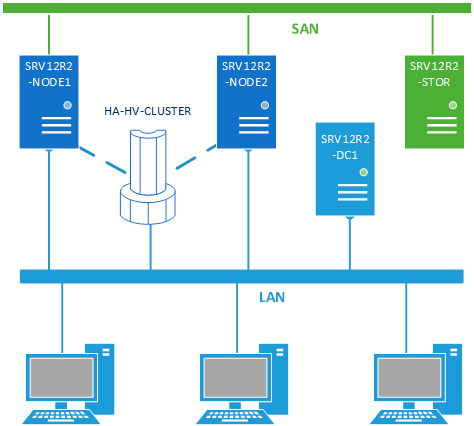

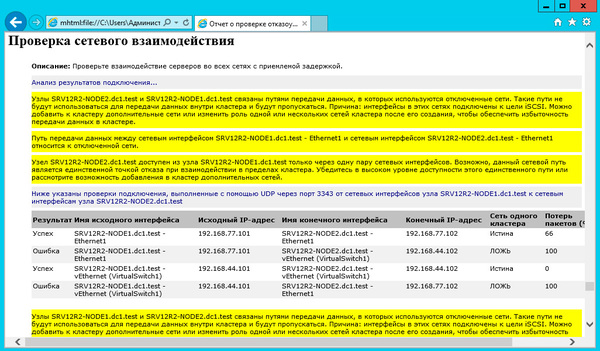

В данном материале мы будем рассматривать наиболее простую конфигурацию отказоустойчивого кластера, состоящего из двух узлов (нод) SRV12R2-NODE1 и SRV12R2-NODE2, каждый из которых работает под управлением Windows Server 2012 R2. Обязательным условием для этих серверов является применение процессоров одного производителя, только Intel или только AMD, в противном случае миграция виртуальных машин между узлами будет невозможна. Каждый узел должен быть подключен к двум сетям: сети предприятия LAN и сети хранения данных SAN.

Вторым обязательным условием для создания кластера является наличие развернутой Active Directory, в нашей схеме она представлена контроллером домена SRV12R2-DC1.

Хранилище выполнено по технологии iSCSI и может быть реализовано на любой подходящей платформе, в данном случае это еще один сервер на Windows Server 2012 R2 - SRV12R2-STOR. Сервер хранилища может быть подключен к сети предприятия и являться членом домена, но это необязательное условие. Пропускная способность сети хранения данных должна быть не ниже 1 Гбит/с.

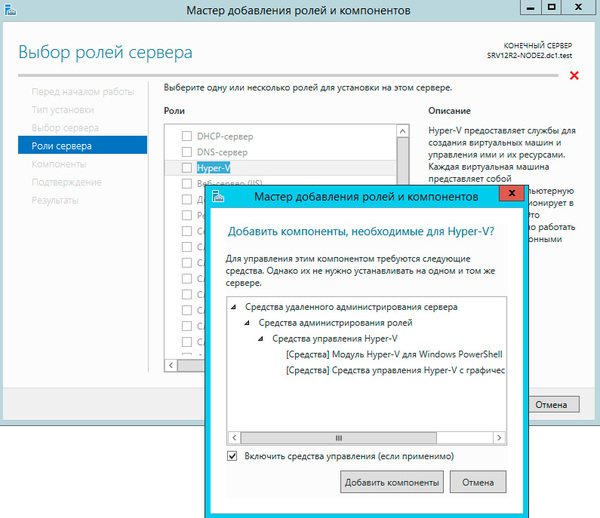

Будем считать, что на оба узла уже установлена операционная система, они введены в домен и сетевые подключения настроены. Откроем Мастер добавления ролей и компонентов и добавим роль Hyper-V.

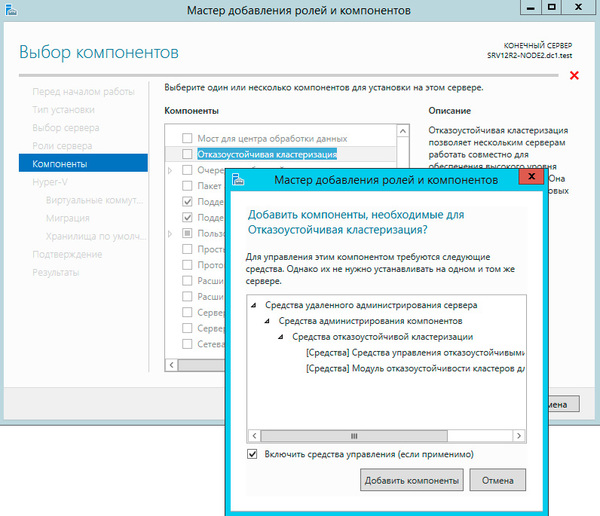

Следующим шагом добавим компоненту Отказоустойчивая кластеризация.

На странице настройки виртуальных коммутаторов выбираем тот сетевой адаптер, который подключен к сети предприятия.

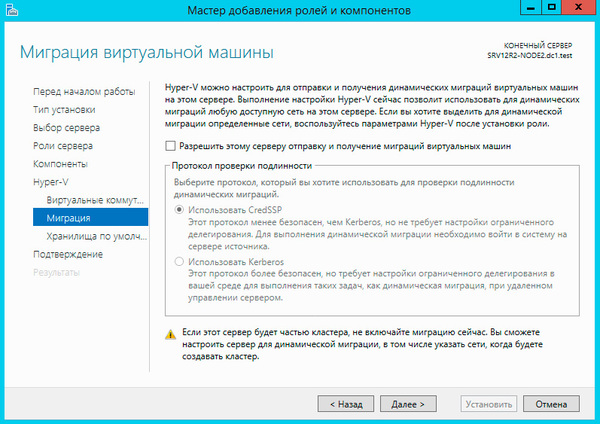

Миграцию виртуальных машин оставляем выключенной.

Остальные параметры оставляем без изменения. Установка роли Hyper-V потребует перезагрузку, после чего аналогичным образом настраиваем второй узел.

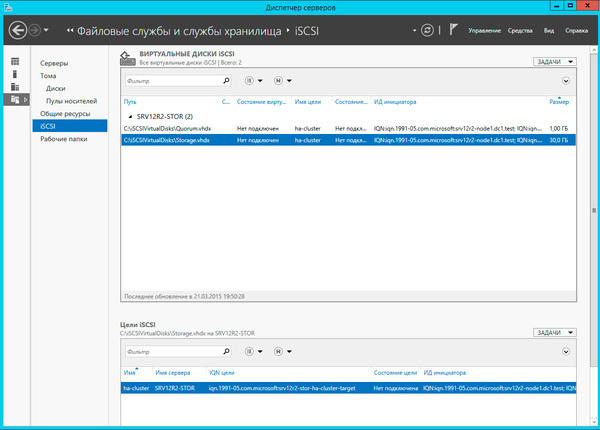

Затем перейдем к серверу хранилища, как настроить iSCSI-хранилище на базе Windows Server 2012 мы рассказывали в данной статье, но это непринципиально, вы можете использовать любой сервер цели iSCSI. Для нормальной работы кластера нам потребуется создать минимум два виртуальных диска: диск свидетеля кворума и диск для хранения виртуальных машин. Диск-свидетель - это служебный ресурс кластера, в рамках данной статьи мы не будем касаться его роли и механизма работы, для него достаточно выделить минимальный размер, в нашем случае 1ГБ.

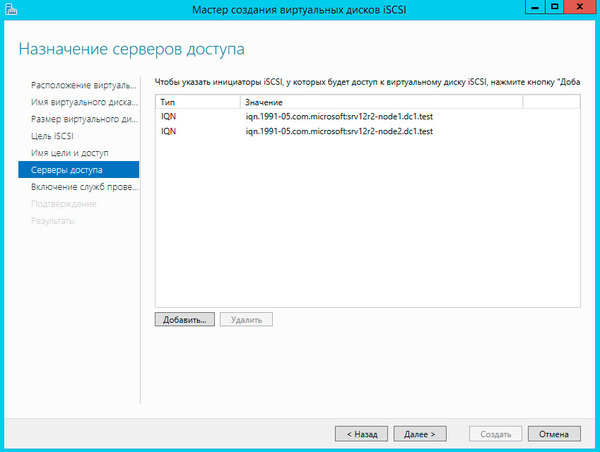

Создайте новую цель iSCSI и разрешите доступ к ней двум инициаторам, в качестве которых будут выступать узлы кластера.

И сопоставьте данной цели созданные виртуальные диски.

Настроив хранилище, вернемся на один из узлов и подключим диски из хранилища. Помните, что если сервер хранилища подключен также к локальной сети, то при подключении к цели iSCSI укажите для доступа сеть хранения данных.

Подключенные диски инициализируем и форматируем.

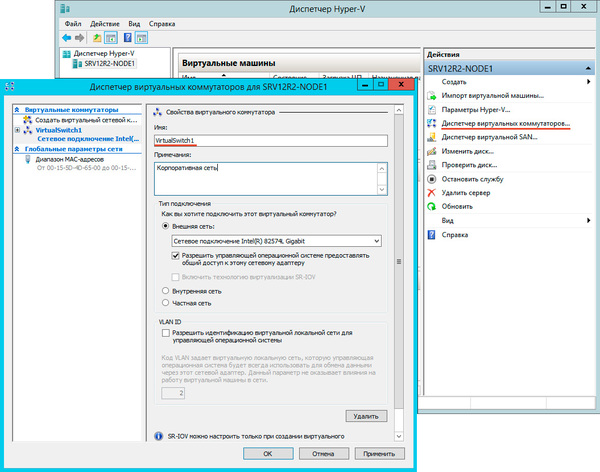

После чего откроем Диспетчер Hyper-V и перейдем к настройке виртуальных коммутаторов. Их название на обоих узлах должно полностью совпадать.

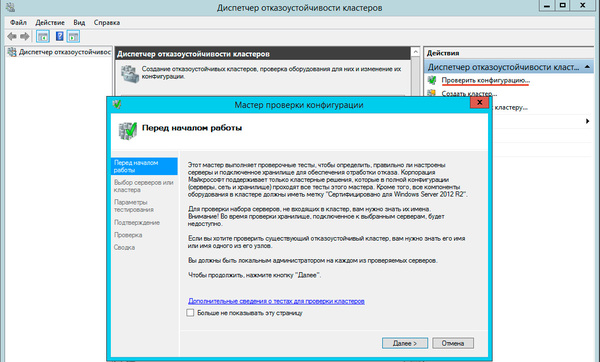

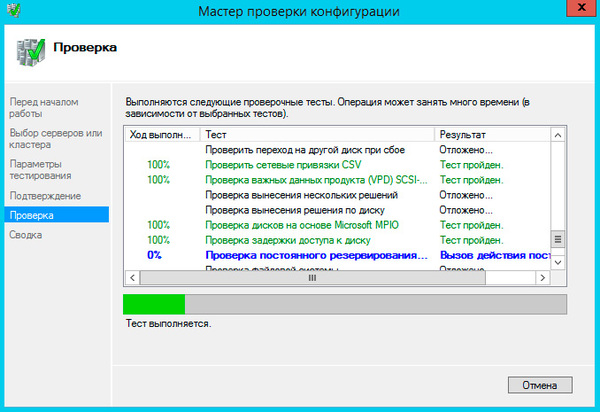

Теперь у нас все готово к созданию кластера. Запустим оснастку Диспетчер отказоустойчивых кластеров и выберем действие Проверить конфигурацию.

В настройках мастера добавим настроенные нами узлы и выберем выполнение всех тестов.

Если существенных ошибок не обнаружено работа мастера завершится и он предложит вам создать на выбранных узлах кластер.

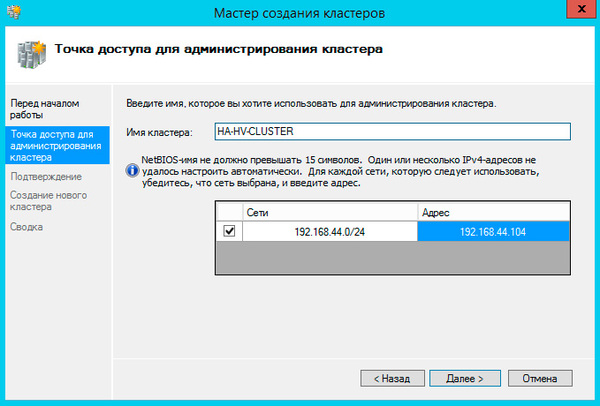

При создании кластера для него создается виртуальный объект, обладающий сетевым именем и адресом. Укажем их в открывшемся Мастере создания кластеров.

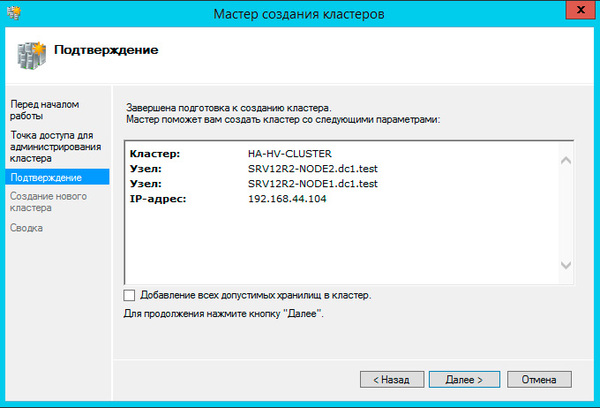

На следующем шаге советуем снять флажок Добавление всех допустимых хранилищ в кластер, так как мастер не всегда правильно назначает роли дискам и все равно придется проверять и, при необходимости исправлять, вручную.

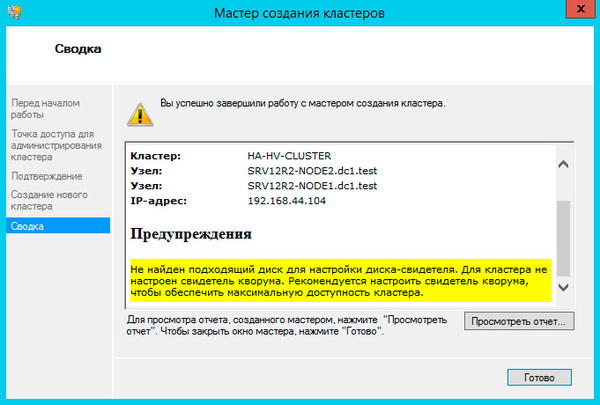

Больше вопросов не последует и мастер сообщит нам, что кластер создан, выдав при этом предупреждение об отсутствии диска-свидетеля.

Закроем мастер и развернем дерево слева до уровня Хранилище - Диски, в доступных действиях справа выберем Добавить диск и укажем подключаемые диски в открывшемся окне, в нашем случае их два.

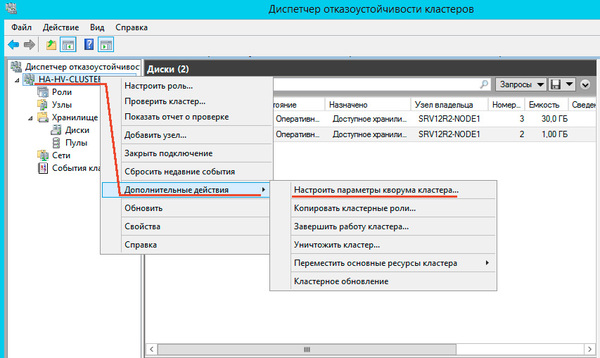

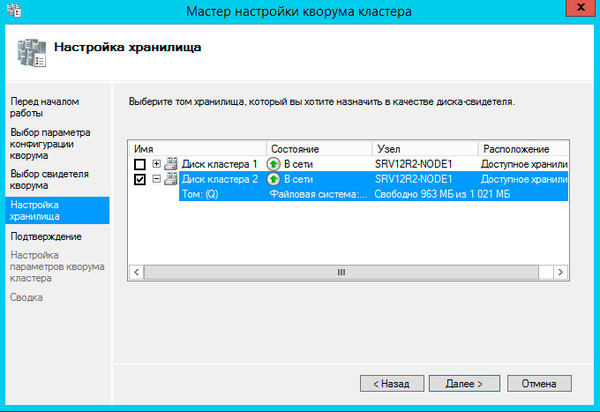

Далее последовательно выбираем: Выбрать свидетель кворума - Настроить диск-свидетель и указываем созданный для этих целей диск.

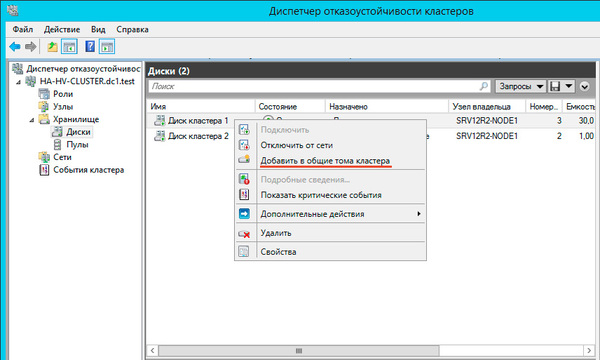

Теперь настроим диск хранилища, с ним все гораздо проще, просто щелкаем на диске правой кнопкой и указываем: Добавить в общие хранилища кластера.

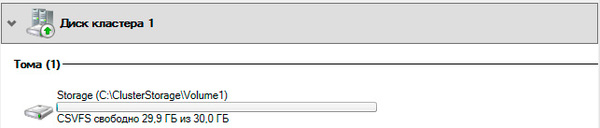

Для того, чтобы диск мог использоваться сразу несколькими участниками кластера на нем создается CSVFS - реализуемая поверх NTFS кластерная файловая система, впервые появившаяся в Windows Server 2008 R2 и позволяющая использовать такие функции как Динамическая (Живая) миграция, т.е. передачу виртуальной машины между узлами кластера без остановки ее работы.

Общие хранилища становятся доступны на всех узлах кластера в расположении C:\ClusterStorage\VolumeN. Обратите внимание, что это не просто папки на системном диске, а точки монтирования общих томов кластера.

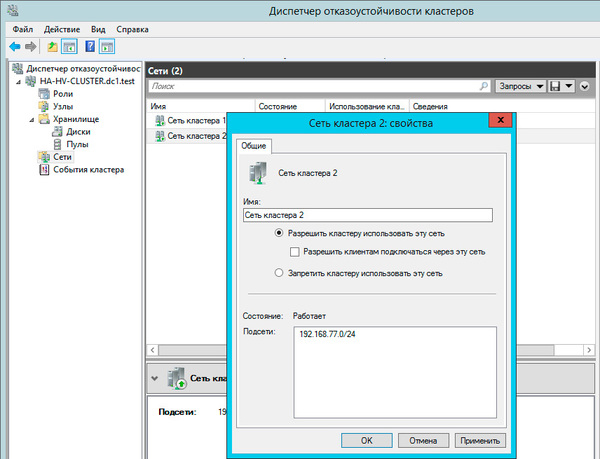

Закончив с дисками, перейдем к настройкам сети, для этого перейдем в раздел Сети. Для сети, которая подключена к сети предприятия указываем Разрешить кластеру использовать эту сеть и Разрешить клиентам подключаться через эту сеть. Для сети хранения данных просто оставим Разрешить кластеру использовать эту сеть, таким образом обеспечив необходимую избыточность сетевых соединений.

На этом настройка кластера закончена. Для работы с кластеризованными виртуальными машинами следует использовать Диспетчер отказоустойчивости кластеров, а не Диспетчер Hyper-V, который предназначен для управления виртуалками расположенными локально.

Чтобы создать виртуальную машину перейдите в раздел Роли в меню правой кнопки мыши выберите Виртуальные машины - Создать виртуальную машину, это же можно сделать и через панель Действия справа.

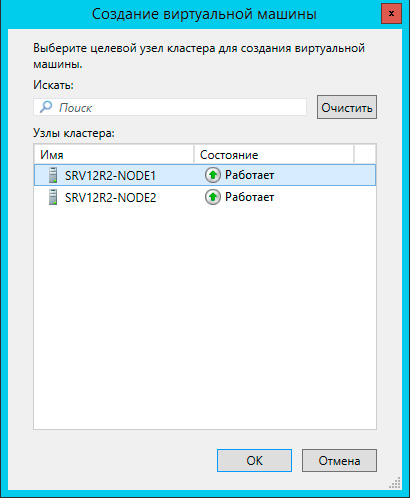

Прежде всего выберите узел, на котором будет создана виртуальная машина. Каждая виртуалка работает на определенном узле кластера, мигрируя на другие узлы при остановке или отказе своей ноды.

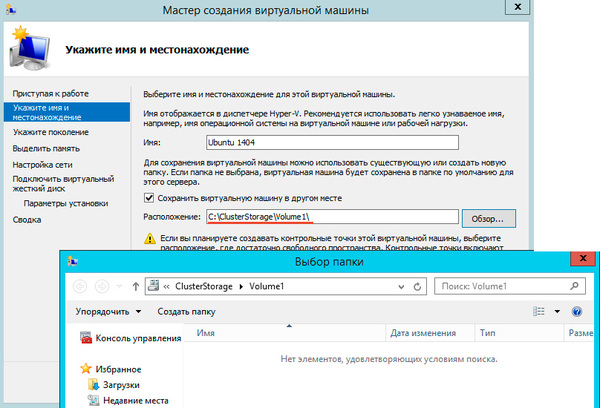

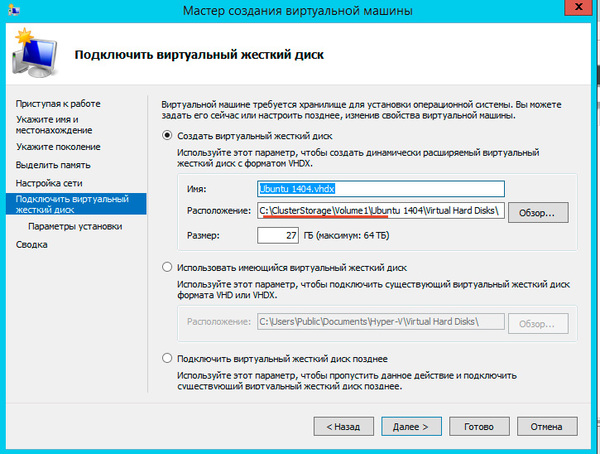

После выбора узла откроется стандартный Мастер создания виртуальной машины, работа с ним не представляет сложности, поэтому остановимся только на значимых моментах. В качестве расположения виртуальной машины обязательно укажите один из общих томов кластера C:\ClusterStorage\VolumeN.

Здесь же должен располагаться и виртуальный жесткий диск, вы также можете использовать уже существующие виртуальные жесткие диски, предварительно скопировав их в общее хранилище.

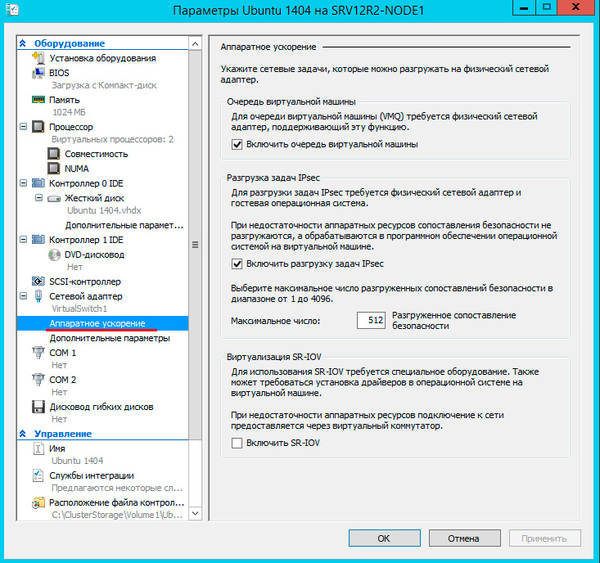

После создания виртуальной машины перейдите в ее Параметры и в пункте Процессоры - Совместимость установите флажок Выполнить перенос на физический компьютер с другой версией процессора, это позволит выполнять миграцию между узлами с разными моделями процессоров одного производителя. Миграция с Intel на AMD или наоборот невозможна.

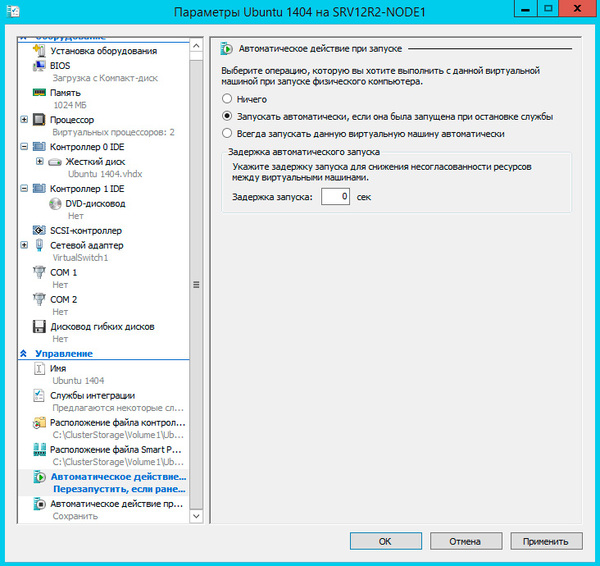

Не забудьте настроить автоматические действия при запуске и завершении работы узла, при большом количестве виртуальных машин не забывайте устанавливать задержку запуска, чтобы избежать чрезмерной нагрузки на систему.

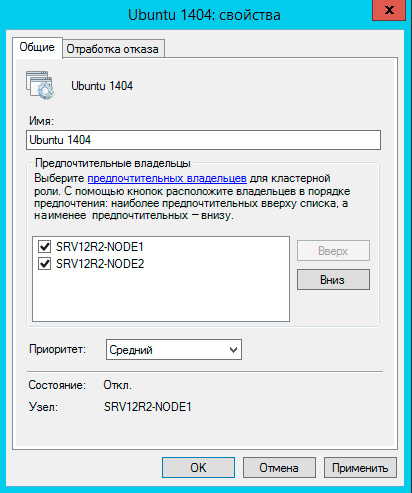

Закончив с Параметрами перейдите в Свойства виртуальной машины и укажите предпочтительные узлы владельцев данной роли в порядке убывания и приоритет, машины имеющие более высокий приоритет мигрируют первыми.

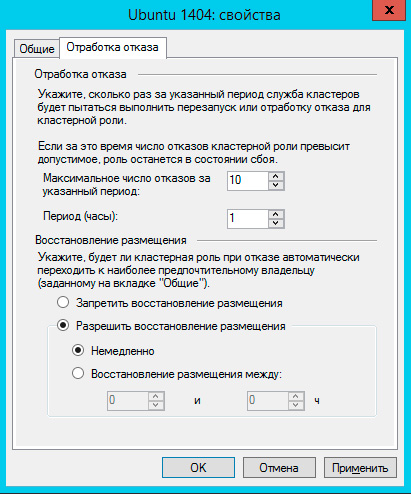

На закладке Обработка отказа задайте количество допустимых отказов для виртуальной машины за единицу времени, помните, что отказом считается не только отказ узла, но и потеря пульса виртуальной машины, например, ее зависание. На время настройки и тестов есть смысл указать значения побольше.

Также настройте Восстановление размещения, эта опция позволяет передавать виртуальные машины обратно наиболее предпочтительному владельцу при восстановлении его нормальной работы. Чтобы избежать чрезмерных нагрузок воспользуйтесь опцией задержки восстановления.

На этом настройка виртуальной машины закончена, можем запускать и работать с ней.

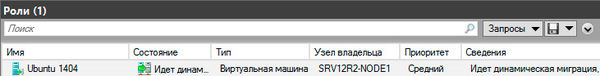

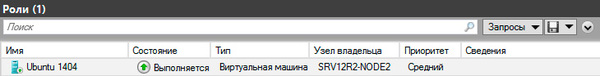

Теперь самое время проверить миграцию, для этого щелкните на машине правой кнопкой мыши и выберите Переместить - Динамическая миграция - Выбрать узел. Виртуалка должна переместиться на выбранную ноду не завершая работы.

Каким образом происходит миграция в рабочей обстановке? Допустим нам надо выключить или перезагрузить первый узел, на котором в данный момент выполняется виртуальная машина. Получив команду на завершение работы узел инициирует передачу виртуальных машин:

Завершение работы приостанавливается до тех пор, пока не будут переданы все виртуальные машины.

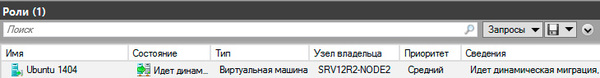

Когда работа узла будет восстановлена, кластер, если включено восстановление размещения, инициирует обратный процесс, передавая виртуальную машину назад предпочтительному владельцу.

Что произойдет если узел, на котором размещены виртуальные машины аварийно выключится или перезагрузится? Все виртуалки также аварийно завершат свою работу, но тут-же будут перезапущены на исправных узлах согласно списка предпочтительных владельцев.

Как мы уже говорили, прижившийся в отечественной технической литературе термин "отказоустойчивый" неверен и более правильно его было бы переводить как "с обработкой отказа", либо использовать понятие "высокая доступность", которое отражает положение дел наиболее верно.

Кластер Hyper-V не обеспечивает отказоустойчивости виртуальным машинам, отказ узла приводит к отказу всех размещенных на нем машин, но он позволяет обеспечить вашим службам высокую доступность, автоматически восстанавливая их работу и обеспечивая минимально возможное время простоя. Также он позволяет значительно облегчить администрирование виртуальной инфраструктуры позволяя перемещать виртуальные машины между узлами без прерывания их работы.

После нескольких лет молчания, решил поделиться опытом по развертыванию отказоустойчивого кластера на основе Windows Server 2012.

Постановка задачи: Развернуть отказоустойчивый кластер для размещения на нем виртуальных машин, с возможностью выделения виртуальных машин в отдельные виртуальные подсети (VLAN), обеспечить высокую надежность, возможность попеременного обслуживания серверов, обеспечить доступность сервисов. Обеспечить спокойный сон отделу ИТ.

- Сервер HP ProLiant DL 560 Gen8 4x Xeon 8 core 64 GB RAM 2 шт.

- SAS Хранилище HP P2000 на 24 2,5» дисков 1 шт.

- Диски для хранилища 300 Gb 24 шт. //С объемом не густо, но к сожалению бюджеты такие бюджеты…

- Контроллер для подключения SAS производства HP 2 шт.

- Сетевой адаптер на 4 1Gb порта 2 шт. //Можно было взять модуль под 4 SFP, но у нас нет оборудования с поддержкой 10 Gb, гигабитного соединения вполне достаточно.

Пока качаются обновления на свежеустановленную Windows Server 2012, настроим дисковое хранилище. Мы планируем развернуть сервер баз данных, посему решили 600 Гб использовать под базы данных, остальное под остальные виртуальные машины, такая вот тавтология.

- Диск raid10 на основе Raid 1+0 из 4 дисков +1 spare

- Диск raid5 на основе Raid 5 из 16 дисков +1 spare

- 2 диска — ЗИП

- raid5_quorum — Так называемый диск-свидетель (witness). Необходим для организации кластера из 2 нод.

- raid5_store — Здесь мы будем хранить виртуальные машины и их жесткие диски

- raid10_db — Здесь будет хранится жесткий диск виртуальной машины MS SQL сервера

- Подключили 1 сервер к 1 контроллеру хранилища

- В хранилище появится 1 подключенный хост — дайте ему имя. Советую называть так: имясервера_номер контроллера (A или B)

- И так, пока не подключите оба сервера к обоим контроллерам.

- ClusterNetwork — здесь ходит служебная информаци кластера (хэртбит, регулирование записи на хранилище)

- LiveMigration — тут думаю все ясно

- Management — сеть для управления

На этом подготовка инфраструктуры закончена. Переходим к настройке серверов и поднятию кластера.

Заводим сервера в домен. Устанавливаем роль Hyper-V, Failover Cluster.

В настройках Multipath IO включаем поддержку SAS устройств.

Обязательно перезагружаем.

Следующие настройки необходимо выполнить на обоих серверах.

Переименуйте все 4 сетевых интерфейса в соответствии их физическим портам (у нас это 1,2,3,4).

Настраиваем NIC Teaming — Добавляем все 4 адаптера в команду, Режим (Teaming-Mode) — Switch Independent, Балансировка нагрузки (Load Balancing) — Hyper-V Port. Даем имя команде, я так и назвал Team.

Теперь необходимо поднять виртуальный коммутатор.

Открываем powershell и пишем:

New-VMSwitch "VSwitch" -MinimumBandwidthMode Weight -NetAdapterName "Team" -AllowManagementOS 0

Создаем 3 виртуальных сетевых адаптера.

В том же powershell:

Add-VMNetworkAdapter –ManagementOS –Name "Management" Add-VMNetworkAdapter –ManagementOS –Name "ClusterNetwork"Add-VMNetworkAdapter –ManagementOS –Name "Live Migration"

Эти виртуальные коммутаторы появятся в центре управления сетями и общим доступом, именно по ним и будет ходить траффик наших серверов.

Настройте адресацию в соответствии с вашими планами.

Переводим наши адапетры в соответствующие VLAN’ы.

В любимом powershell:

Set-VMNetworkAdapterVlan -ManagementOS -Access -VlanId 2 -VMNetworkAdapterName "Management" -Confirm Set-VMNetworkAdapterVlan -ManagementOS -Access -VlanId 3 -VMNetworkAdapterName "ClusterNetwork" -Confirm Set-VMNetworkAdapterVlan -ManagementOS -Access -VlanId 4 -VMNetworkAdapterName "Live Migration" -Confirm

Теперь нужно настроить QoS.

При настройке QoS by weight (по весу), что является best practice, по заявлению Microsoft, советую расставить вес так, чтобы в общей сумме получилось 100, тогда можно считать, что значение указанное в настройке есть гарантированный процент полосы пропускания. В любом случае считается процент по формуле:

Процент полосы пропускания = установленный вес * 100 / сумма всех установленных значений веса

Set-VMSwitch “VSwitch” -DefaultFlowMinimumBandwidthWeight 15

Для служебной информации кластера.

Set-VMNetworkAdapter -ManagementOS -Name “Cluster” -MinimumBandwidthWeight 30

Set-VMNetworkAdapter -ManagementOS -Name "Management" -MinimumBandwidthWeight 5

Set-VMNetworkAdapter -ManagementOS -Name “Live Migration” -MinimumBandwidthWeight 50

Чтобы трафик ходил по сетям верно, необходимо верно расставить метрики.

Трафик служебной информации кластера будет ходит по сети с наименьшей метрикой.По следующей по величине метрики сети будет ходить Live Migration.

Давайте так и сделаем.

В нашем ненаглядном:

$n = Get-ClusterNetwork “ClusterNetwork” $n.Metric = 1000 $n = Get-ClusterNetwork “LiveMigration” $n.Metric = 1050$n = Get-ClusterNetwork “Management” $n.Metric = 1100

Монтируем наш диск-свидетель на ноде, с которой будем собирать кластер, форматируем в ntfs.

В оснастке Failover Clustering в разделе Networks переименуйте сети в соответствии с нашими адаптерами.

Все готово к сбору кластера.

В оснастке Failover Clustering жмем validate. Проходим проверку. После чего создаем кластер (create cluster) и выбираем конфигурацию кворума (quorum configuration) Node and Disk majority, что также считается лучшим выбором для кластеров с четным количеством нод, а учитывая, что у нас их всего две — это единственный выбор.

В разделе Storage оснастки Failover Clustering, добавьте ваши диски. А затем по очереди добавляйте их как Cluster Shared Volume (правый клик по диску). После добавления в папке C:\ClusterStorage появится символическая ссылка на диск, переименуйте ее в соответствии с названием диска, добавленного как Cluster Shared Volume.

Теперь можно создавать виртуальные машины и сохранять их на эти разделы. Надеюсь статья была Вам полезна.

Прошу сообщать об ошибках в ПМ.

Советую к прочтению: Microsoft Windows Server 2012 Полное руководство. Рэнд Моримото, Майкл Ноэл, Гай Ярдени, Омар Драуби, Эндрю Аббейт, Крис Амарис.

В этом разделе описывается, как создать отказоустойчивый кластер с помощью оснастки диспетчера отказоустойчивости кластеров или Windows PowerShell. В нем рассматривается типичное развертывание, при котором объекты-компьютеры для кластера и связанные с ним кластерные роли создаются в доменных службах Active Directory (AD DS). если вы развертываете дисковые пространства прямой кластер, см. раздел развертывание дисковые пространства direct. Сведения об использовании отказоустойчивого кластера в Azure Stack ХЦИ см. в статье создание Azure Stack хЦи.

Также можно развернуть кластер, отсоединенный Active Directory. Этот метод развертывания позволяет создать отказоустойчивый кластер без разрешений на создание объектов-компьютеров в AD DS или необходимости запрашивать эти объекты-компьютеры в AD DS. Он возможен только посредством Windows PowerShell и рекомендуется только в определенных сценариях. Дополнительные сведения см. в разделе о развертывании отсоединенного от Active Directory кластера.

Контрольный список: Создание отказоустойчивого кластера

| Состояние | Задача | Справочник |

|---|---|---|

| ☐ | Проверка предварительных требований | Проверьте предварительные требования. |

| ☐ | Установка средства отказоустойчивости кластеров на всех серверах, которые необходимо добавить как узлы кластера | Установка средства отказоустойчивости кластеров |

| ☐ | Запуск мастера проверки кластеров для проверки конфигурации | Проверка конфигурации |

| ☐ | Запуск мастера создания кластера для создания отказоустойчивого кластера | Создание отказоустойчивого кластера. |

| ☐ | Создание кластерных ролей для размещения рабочих нагрузок кластера | Создание кластерных ролей |

Проверка предварительных требований

Перед началом работы проверьте выполнение следующих необходимых условий.

- Убедитесь в том, что все серверы, которые нужно добавить в качестве узлов кластера, работают под управлением одной и той же версии Windows Server.

- Изучите требования к оборудованию, чтобы убедиться в том, что ваша конфигурация поддерживается. Подробнее см. в разделе Требования к оборудованию для отказоустойчивой кластеризации и варианты хранилища. если вы создаете прямой кластер дисковые пространства, см. раздел дисковые пространства direct, требования к оборудованию.

- Чтобы добавить кластерное хранилище во время создания кластера, убедитесь, что все серверы имеют доступ к хранилищу. (Кластерное хранилище можно добавить и после создания кластера.)

- Убедитесь в том, что все серверы, которые нужно добавить в качестве узлов кластера, присоединены к одному и тому же домену Active Directory.

- (Необязательно.) Создайте подразделение и переместите в него учетные записи компьютеров для серверов, которые нужно добавить в качестве узлов кластера. Мы рекомендуем размещать отказоустойчивые кластеры в собственном подразделении в AD DS. Это позволит лучше контролировать параметры групповой политики и шаблона безопасности, применяемые к узлам кластера. Изоляция кластеров в собственном подразделении также помогает предотвратить случайное удаление объектов-компьютеров кластера.

Кроме того, проверьте выполнение указанных ниже требований к учетным записям.

- Убедитесь в том, что учетная запись, которую вы хотите использовать для создания кластера, принадлежит пользователю домена с правами администратора на всех серверах, которые нужно добавить в качестве узлов кластера.

- Убедитесь, что выполняется одно из следующих условий:

- У пользователя, создающего кластер, есть разрешение на создание объектов-компьютеров для подразделения или контейнера, в котором размещаются серверы, которые войдут в кластер.

- Если у пользователя нет разрешения на создание объектов-компьютеров, попросите администратора домена предварительно подготовить объект-компьютер кластера. Подробнее см. в разделе Подготовка кластерных объектов-компьютеров в доменных службах Active Directory.

это требование не применяется, если требуется создать Active Directory отсоединенный кластер в Windows Server 2012 R2. Дополнительные сведения см. в разделе о развертывании отсоединенного от Active Directory кластера.

Установка средства отказоустойчивости кластеров

Средство отказоустойчивости кластеров необходимо установить на всех серверах, которые будут добавлены как узлы отказоустойчивого кластера.

Установка средства отказоустойчивости кластеров

Запустите диспетчер серверов.

В меню Управление выберите команду Добавить роли и компоненты.

На странице перед началом выполнения нажмите кнопку Далее.

На странице Выбор типа установки выберите Установка на основе ролей или компонентов, а затем нажмите кнопку Далее.

На странице Выбор целевого сервера выберите сервер, на котором требуется установить компонент, и нажмите кнопку Далее.

На странице Выбор ролей сервера щелкните Далее.

На странице Выбор компонентов установите флажок Отказоустойчивая кластеризация.

Чтобы установить средства управления отказоустойчивыми кластерами, выберите Добавить компоненты, а затем нажмите кнопку Далее.

На странице Подтверждение выбранных вариантов установки нажмите кнопку установить.

После установки средства отказоустойчивости кластеров не нужно перезапускать сервер.После завершения установки нажмите кнопку Закрыть.

Повторите эту процедуру на каждом сервере, который необходимо добавить как узел отказоустойчивого кластера.

После установки средства отказоустойчивости кластеров рекомендуется применить последние обновления из Центра обновления Windows. кроме того, для отказоустойчивого кластера на основе Windows Server 2012 ознакомьтесь с рекомендуемыми исправлениями и обновлениями для отказоустойчивых кластеров на основе Windows Server 2012 служба поддержки Майкрософт статье и установите все применимые обновления.

Проверка конфигурации

Перед созданием отказоустойчивого кластера настоятельно рекомендуется проверить конфигурацию, чтобы убедиться в том, что оборудование и его настройки совместимы с отказоустойчивой кластеризацией. Корпорация Майкрософт поддерживает кластерное решение, только если конфигурация прошла все проверочные тесты и все оборудование сертифицировано для версии Windows Server, под управлением которой работают узлы кластера.

Для выполнения всех тестов необходимы по крайней мере два узла. Если имеется только один узел, выполнение многих важных тестов хранилища невозможно.

Выполнение тестов проверки кластера

На компьютере, на котором установлены средства управления отказоустойчивыми кластерами из средств удаленного администрирования сервера, или на сервере, на котором установлено средство отказоустойчивости кластеров, запустите диспетчер отказоустойчивости кластеров. Чтобы сделать это на сервере, запустите диспетчер сервера, а затем в меню Сервис выберите Диспетчер отказоустойчивости кластеров.

В области Диспетчер отказоустойчивости кластеров в разделе Управление выберите проверить конфигурацию.

На странице Перед началом работы нажмите кнопку Далее.

На странице Параметры тестирования выберите выполнить все тесты (рекомендуется), а затем нажмите кнопку Далее.

На странице Подтверждение нажмите кнопку Далее.

На странице "Проверка" показано состояние выполняющихся тестов.

На странице Сводка выполните одно из указанных ниже действий.

Если результаты показывают, что тесты успешно завершены и конфигурация подходит для кластеризации, и вы хотите создать кластер немедленно, убедитесь, что установлен флажок создать кластер, использующий проверенные узлы , и нажмите кнопку Готово. Затем перейдите к шагу 4 процедуры Создание отказоустойчивого кластера.

Если получено предупреждение для теста «Проверка постоянного резервирования дисковых пространств», дополнительную информацию см. в записи блога Предупреждение при проверке отказоустойчивого кластера Windows указывает на то, что диски не поддерживают постоянное резервирование дисковых пространств .

Подробнее о проверочных тестах оборудования см. в разделе Проверка оборудования для отказоустойчивого кластера.

Создание отказоустойчивого кластера.

Чтобы выполнить это действие, убедитесь в том, что учетная запись пользователя, с помощью которой вы вошли в систему, соответствует требованиям, указанным в подразделе Проверка предварительных требований этого раздела.

Запустите диспетчер серверов.

В меню Сервис выберите Диспетчер отказоустойчивости кластеров.

В области Диспетчер отказоустойчивости кластеров в разделе Управление выберите создать кластер.

Откроется мастер создания кластеров.

На странице Перед началом работы нажмите кнопку Далее.

Если вы решили создать кластер сразу после выполнения проверки в процедуре Проверка конфигурации, страница Выбор серверов не отображается. Проверенные узлы автоматически добавляются в мастер создания кластеров, так что вводить их еще раз не нужно.

Если ранее вы пропустили проверку, появится страница Предупреждение проверки. Настоятельно рекомендуется выполнить проверку кластера. Корпорация Майкрософт поддерживает только те кластеры, которые прошли все проверочные тесты. Чтобы выполнить проверочные тесты, выберите Да, а затем нажмите кнопку Далее. Завершите работу мастера проверки конфигурации, как описано в разделе Проверка конфигурации.

На странице Точка доступа для администрирования кластера выполните указанные ниже действия.

В поле Имя кластера введите имя, которое необходимо использовать для администрирования кластера. Перед этим изучите приведенную ниже информацию.

- В процессе создания кластера это имя регистрируется в качестве объекта-компьютера кластера (также известного как объект имени кластера или CNO) в доменных службах Active Directory. Если для кластера указано имя NetBIOS, объект CNO создается в том же расположении, в котором находятся объекты-компьютеры узлов кластера. Это может быть контейнер "Компьютеры" (по умолчанию) или подразделение.

- Чтобы указать другое расположение для CNO, можно ввести различающееся имя подразделения в поле Имя кластера. Например: CN=ClusterName, OU=Clusters, DC=Contoso, DC=com.

- Если администратор домена предварительно подготовил CNO в подразделении, отличном от того, в котором размещаются узлы кластера, укажите различающееся имя, предоставленное администратором домена.

Если на сервере нет сетевого адаптера, настроенного на использование DHCP, для отказоустойчивого кластера необходимо настроить один или несколько статических IP-адресов. Установите флажок напротив каждой сети, которую необходимо использовать для управления кластером. Выберите поле адреса рядом с выбранной сетью, а затем введите IP-адрес, который нужно назначить кластеру. Этот IP-адрес (или адреса) будет связан с именем кластера в службе доменных имен (DNS).

если вы используете Windows Server 2019, у вас есть возможность использовать имя распределенной сети для кластера. Имя распределенной сети использует IP-адреса рядовых серверов вместо использования выделенного IP-адреса для кластера. по умолчанию Windows использует имя распределенной сети, если обнаруживает, что вы создаете кластер в Azure (поэтому вам не нужно создавать внутренний балансировщик нагрузки для кластера) или обычный статический или IP-адрес, если вы работаете в локальной среде. Дополнительные сведения см. в разделе имя распределенной сети.

- По завершении нажмите кнопку Далее.

Просмотрите параметры на странице Подтверждение. По умолчанию установлен флажок Добавление всех допустимых хранилищ в кластер. Снимите его в указанных ниже случаях.

- Хранилище следует настроить позднее.

- Вы планируете создать кластерные дисковые пространства с помощью диспетчера отказоустойчивости кластеров или командлетов отказоустойчивой кластеризации Windows PowerShell, но еще не создали дисковые пространства в файловых службах и службах хранилища. Подробнее см. в разделе Развертывание кластерных дисковых пространств.

Чтобы убедиться в том, что кластер создан, проверьте, указано ли его имя в разделе Диспетчер отказоустойчивости кластеров в дереве навигации. можно развернуть имя кластера, а затем выбрать элементы в разделе узлы, служба хранилища или сети , чтобы просмотреть связанные ресурсы.

Имейте в виду, что на успешную репликацию имени кластера в службе DNS может потребоваться некоторое время. После успешной регистрации и репликации DNS при выборе всех серверов в Диспетчер сервера имя кластера должно быть указано как сервер с состоянием управляемости в сети.

После создания кластера можно выполнить такие действия, как проверка конфигурации кворума кластера и создание общих томов кластера — CSV (необязательно). дополнительные сведения см. в разделе понимание кворума в дисковые пространства Direct и использование общих томов кластера в отказоустойчивом кластере.

Создание кластерных ролей

После создания отказоустойчивого кластера можно создать кластерные роли для размещения кластерных рабочих нагрузок.

Для кластерных ролей, требующих точки доступа клиента, в доменных службах Active Directory создается виртуальный объект-компьютер (VCO). По умолчанию все объекты VCO для кластера создаются в том же контейнере или подразделении, что и объект CNO. Имейте в виду, что после создания кластера объект CNO можно переместить в любое подразделение.

Вот как можно создать кластерную роль:

Чтобы на каждом узле отказоустойчивого кластера установить роль или компонент, необходимый для кластерной роли, используйте диспетчер сервера или Windows PowerShell. Например, чтобы создать кластерный файловый сервер, установите роль файлового сервера на всех узлах кластера.

В таблице ниже приведены кластерные роли, которые можно настроить в мастере высокой доступности, и соответствующие роли или компоненты сервера, которые необходимо установить.

В диспетчер отказоустойчивости кластеров разверните узел имя кластера, щелкните правой кнопкой мыши элемент роли и выберите пункт настроить роль.

Для создания кластерной роли выполните последовательность действий, предлагаемую мастером высокой доступности.

Чтобы проверить, создана ли кластерная роль, на панели Роли убедитесь в том, что роль имеет состояние Выполняется. На панели "Роли" также указан узел владельца. Чтобы протестировать отработку отказа, щелкните правой кнопкой мыши роль, выберите пункт переместить, а затем выберите пункт выбрать узел. В диалоговом окне Перемещение кластерной роли выберите нужный узел кластера и нажмите кнопку ОК. В столбце Узел владельца убедитесь в том, что узел владельца изменился.

Создание отказоустойчивого кластера с помощью Windows PowerShell

следующие командлеты Windows PowerShell выполняют те же функции, что и предыдущие процедуры в этом разделе. Введите каждый командлет в отдельной строке, даже если кажется, что из-за ограничения возможностей форматирования они переносятся по словам на другую строку.

для создания Active Directory отсоединенного кластера в Windows Server 2012 R2 необходимо использовать Windows PowerShell. Информацию о синтаксисе см. в разделе Развертывание отсоединенного от Active Directory кластера.

В приведенном ниже примере устанавливается средство отказоустойчивости кластеров.

В приведенном ниже примере запускаются все проверочные тесты кластера на компьютерах с именами Server1 и Server2.

Командлет Test-Cluster выводит результаты в файл журнала в текущем рабочем каталоге. Например: C:\Users <username> \AppData\Local\Temp.

В приведенном ниже примере создается отказоустойчивый кластер с именем MyCluster и узлами Server1 и Server2; ему присваивается статический IP-адрес 192.168.1.12, и в него добавляются все подходящие дисковые пространства.

В приведенном ниже примере создается такой же отказоустойчивый кластер, что и в предыдущем примере, но в него не добавляются подходящие дисковые пространства.

После создания отказоустойчивого кластера с отключенным AD создайте резервную копию сертификата с возможностью экспорта закрытого ключа. Откройте MMC = =>файл = =>добавить оснастку "Удалить" в = =>Certificates =>=>локальный компьютер = =>службы кластеров = =>Certificates = =>Клуссвк\персонал = =>выбор сертификата — щелкните правой кнопкой мыши = =>Export = =>далее = =>Да экспорт закрытого ключа = =>формат PfX = =>выбрать пароль или добавить группу = =>следующий = =>выберите путь, по которому нужно сохранить сертификат = =>далее = =>готово.

Продолжаем тему Cluster Shared Volumes в Windows Server 2012 R2. В предыдущей статье мы затронули общий принцип работы, сегодня же посмотрим на CSV с более практической точки зрения. Для опытов у меня как раз завалялся 🙂 3-х узловой кластер с общим диском, который и будет использоваться под CSV.

Создание CSV

![диск в Failover Cluster Manager до преобразования в CSV]()

а в проводнике он виден как обычный логический диск.

![диск в Проводнике до преобразования в CSV]()

Теперь кликаем на диске правой клавишей мыши и в контекстном меню выбираем пункт «Add to Cluster Shared Volumes».

![добавление диска в CSV]()

После преобразования диск отображается как общий кластерный том (Cluster Shared Volume), а в качестве файловой системы у него CSVFS. Впрочем на самом деле файловая система осталась прежней, а CSVFS показана лишь для того, чтобы администратору и приложениям проще различать обычные и CSV тома.

![диск в Failover Cluster Manager после преобразования в CSV]()

В проводнике же диск теперь виден не как обычный том, а как подключенная папка. Все диски после добавления в CSV отображаются на всех узлах кластера как подкаталоги в папке %systemdrive%\ClusterStorage и по умолчанию именуются как Volume1, Volume2 и т.д. Так в нашем случае общий том имеет путь C:\ClusterStorage\Volume1. Каталог Volume1 при желании можно переименовать, дав ему более осмысленное название, а вот папку ClusterStorage нельзя ни в коем случае трогать.

![диск в Проводнике после преобразования в CSV]()

![удаление диска из CSV]()

Не забываем о PowerShell. Добавить диск в CSV можно командой:

Add-ClusterSharedVolume -Cluster Cluster1 -Name ″Cluster Disk 1″

Ну а удалить, соответственно:

Remove-ClusterSharedVolume -Cluster Cluster1 -Name ″Cluster Disk 1″

И еще один интересный момент. На каждом узле кластера с CSV создается скрытая административная шара с именем ClusterStorage$. Она доступна только для членов группы администраторов, на нее можно зайти удаленно по пути \\«имя кластера»\ClusterStorage$, в нашем случае это \\Cluster1\ClusterStorage$.

![скрытая шара ClusterStorage$]()

Режимы работы CSV

Теперь рассмотрим более подробно режимы работы CSV. Для начала выведем имеющиеся в наличии тома CSV командой:

А затем выведем состояние тома:

Get-ClusterSharedVolumeState -Name ″Cluster Disk 1″

Как видите, сейчас все узлы работают в штатном режиме (Direct), без перенаправления.

![режим работы CSV без редиректа]()

Теперь переведем наш CSV в режим перенаправления (File System Redirected mode). В этом режиме все операции, как с данными так и с метаданными будут производиться только через узел-координатор.

Для включения перенаправления надо выбрать нужный том CSV, кликнуть на нем правой клавишей и нажать «Turn On Redirected Access».

![включение FileSystem redirect]()

Также можно включить перенаправление из PowerShell, командой:

Suspend-ClusterResource -Name ″Cluster Disk 1″ -RedirectedAccess -Force

Теперь CSV на всех узлах кластера находится в состоянии FileSystemRedirected, а в качестве причины указан запрос пользователя (UserRequest).

![CSV в режиме FileSystem redirect]()

Для выключения режима перенаправления надо также кликнуть мышкой на томе и нажать на Turn off Redirected Access, либо выполнить команду:

Resume-ClusterResource -Name ″Cluster Disk 1″

И остается еще один режим перенаправления блочного доступа (Block Redirected), при котором узел не имеет прямого доступа к хранилищу, а блочные данные передаются по сети через узел-координатор. Для активации этого режима отключим на узле кластера SRV4 сетевой интерфейс, отвечающий за подключение к дисковому хранилищу.

Как видите, теперь узел SRV4 находится в режиме BlockRedirected, а причиной переключения является отсутствие прямого подключения к диску (NoDiskConnectivity). Как только подключение к диску будет восстановлено, узел перейдет в нормальный режим работы.

![CSV в режиме Block redirect]()

Заключение

В заключение скажу, что сфера применения общих кластерных томов не особенно широка. Изначально CSV предназначены исключительно для хранения виртуальных дисков Hyper-V. Начиная с Windows Server 2012 на базе CSV можно создавать отказоустойчивые файловые сервера (SOFS). Также SQL Server 2014 вроде как позволяет размещать базы данных на томах CSV.

В данной статье будет показано, как построить отказоустойчивый кластер Server 2012 с двумя узлами. Сначала я перечислю обязательные условия и представлю обзор настроек аппаратной среды, сети и хранилища данных. Затем будет подробно описано, как дополнить Server 2012 функциями отказоустойчивой кластеризации и использовать диспетчер отказоустойчивого кластера для настройки кластера с двумя узлами

В Windows Server 2012 появилось так много новшеств, что за всеми уследить трудно. Часть наиболее важных строительных блоков новой ИТ-инфраструктуры связана с улучшениями в отказоустойчивой кластеризации. Отказоустойчивая кластеризация зародилась как технология для защиты важнейших приложений, необходимых для производственной деятельности, таких как Microsoft SQL Server и Microsoft Exchange. Но впоследствии отказоустойчивая кластеризация превратилась в платформу высокой доступности для ряда служб и приложений Windows. Отказоустойчивая кластеризация — часть фундамента Dynamic Datacenter и таких технологий, как динамическая миграция. Благодаря Server 2012 и усовершенствованиям нового протокола Server Message Block (SMB) 3.0 область действия отказоустойчивой кластеризации стала увеличиваться, обеспечивая непрерывно доступные файловые ресурсы с общим доступом. Обзор функциональности отказоустойчивой кластеризации в Server 2012 приведен в опубликованной в этом же номере журнала статье «Новые возможности отказоустойчивой кластеризации Windows Server 2012».

Обязательные условия отказоустойчивой кластеризации

Для построения двухузлового отказоустойчивого кластера Server 2012 необходимы два компьютера, работающие с версиями Server 2012 Datacenter или Standard. Это могут быть физические компьютеры или виртуальные машины. Кластеры с виртуальными узлами можно построить с помощью Microsoft Hyper-V или VMware vSphere. В данной статье используются два физических сервера, но этапы настройки кластера для физических и виртуальных узлов одни и те же. Ключевая особенность заключается в том, что узлы должны быть настроены одинаково, чтобы резервный узел мог выполнять рабочие нагрузки в случае аварийного переключения или динамической миграции. Компоненты, использованные в тестовом отказоустойчивом кластере Server 2012 представлены на рисунке.

![Просмотр компонентов кластера]()

Рисунок. Просмотр компонентов кластера Для отказоустойчивого кластера Server 2012 необходимо общее хранилище данных типа iSCSI, Serially Attached SCSI или Fibre Channel SAN. В нашем примере используется iSCSI SAN. Следует помнить о следующих особенностях хранилищ этого типа.

Добавление функций отказоустойчивой кластеризации

Первый шаг к созданию двухузлового отказоустойчивого кластера Server 2012 — добавление компонента отказоустойчивого кластера с использованием диспетчера сервера. Диспетчер сервера автоматически открывается при регистрации в Server 2012. Чтобы добавить компонент отказоустойчивого кластера, выберите Local Server («Локальный сервер») и прокрутите список вниз до раздела ROLES AND FEATURES. Из раскрывающегося списка TASKS выберите Add Roles and Features, как показано на экране 1. В результате будет запущен мастер добавления ролей и компонентов.

![Запуск мастера добавления ролей и компонентов]()

Экран 1. Запуск мастера добавления ролей и компонентов На странице Select destination server выберите сервер, на котором следует установить функции отказоустойчивого кластера. В моем случае это локальный сервер с именем WS2012-N1. Выбрав локальный сервер, нажмите кнопку Next, чтобы перейти к странице Select server roles. В данном примере роль сервера не устанавливается, поэтому нажмите кнопку Next. Или можно щелкнуть ссылку Features в левом меню.

![Добавление средства отказоустойчивого кластера и инструментов]()

Экран 2. Добавление средства отказоустойчивого кластера и инструментов На странице Confirm installation selections будет показана функция отказоустойчивого кластера наряду с инструментами управления и модулем PowerShell. С этой страницы можно вернуться и внести любые изменения. При нажатии кнопки Install начнется собственно установка компонентов. После завершения установки работа мастера будет завершена и функция отказоустойчивого кластера появится в разделе ROLES AND FEATURES диспетчера сервера. Этот процесс необходимо выполнить на обоих узлах.

Проверка отказоустойчивого кластера

Следующий шаг после добавления функции отказоустойчивого кластера — проверка настроек среды, в которой создан кластер. Здесь можно воспользоваться мастером проверки настроек в диспетчере отказоустойчивого кластера. Этот мастер проверяет параметры аппаратных средств и программного обеспечения всех узлов кластера и сообщает обо всех проблемах, которые могут помешать организации кластера.

Чтобы открыть диспетчер отказоустойчивого кластера, выберите параметр Failover Cluster Manager в меню Tools в диспетчере сервера. В области Management щелкните ссылку Validate Configuration, как показано на экране 3, чтобы запустить мастер проверки настроек.

![Запуск мастера проверки конфигурации]()

Экран 3. Запуск мастера проверки конфигурации ![Просмотр отчета о проверке]()

Экран 4. Просмотр отчета о проверке Создание отказоустойчивого кластера

На данном этапе можно создать кластер, начиная с любого узла кластера. Я организовал кластер, начав на первом узле (WS2012-N1).

Чтобы создать новый кластер, выберите ссылку Create Cluster на панели Management или панели Actions, как показано на экране 5.

![Запуск мастера создания кластера]()

Экран 5. Запуск мастера создания кластера ![Выбор серверов для кластера]()

Экран 6. Выбор серверов для кластера На странице Access Point for Administering the Cluster следует указать имя и IP-адрес кластера, которые должны быть уникальными в сети. На экране 7 видно, что имя моего кластера WS2012-CL01, а IP-адрес — 192.168.100.200. При использовании Server 2012 IP-адрес кластера может быть назначен через DHCP, но я предпочитаю для своих серверов статически назначаемый IP-адрес.

![Настройка точки доступа кластера]()

Экран 7. Настройка точки доступа кластера После ввода имени и IP-адреса нажмите кнопку Next, чтобы увидеть страницу подтверждения (экран 8). На этой странице можно проверить настройки, сделанные при создании кластера. При необходимости можно вернуться и внести изменения.

![Подтверждение параметров, выбранных при создании кластера]()

Экран 8. Подтверждение параметров, выбранных при создании кластера После нажатия кнопки Next на странице подтверждения формируется кластер на всех выбранных узлах. На странице хода выполнения показаны шаги мастера в процессе создания нового кластера. По завершении мастер покажет страницу сводки с настройками нового кластера.

Мастер создания кластера автоматически выбирает хранилище для кворума, но часто он выбирает не тот диск кворума, который хотелось бы администратору. Чтобы проверить, какой диск используется для кворума, откройте диспетчер отказоустойчивого кластера и разверните кластер. Затем откройте узел Storage и щелкните узел Disks. Диски, доступные в кластере, будут показаны на панели Disks. Диск, выбранный мастером для кворума кластера, будет указан в разделе Disk Witness in Quorum.

В данном примере для кворума был использован Cluster Disk 4. Его размер 520 Мбайт, чуть больше минимального значения для кворума 512 Мбайт. Если нужно использовать другой диск для кворума кластера, можно изменить настройки кластера, щелкнув правой кнопкой мыши имя кластера в диспетчере отказоустойчивого кластера, выбрав пункт More Actions и Configure Cluster Quorum Settings. В результате появится мастер выбора конфигурации кворума, с помощью которого можно изменить параметры кворума кластера.

Настройка общих томов кластера и роли виртуальных машин

Оба узла в моем кластере имеют роль Hyper-V, так как кластер предназначен для виртуальных машин с высокой доступностью, обеспечивающих динамическую миграцию. Чтобы упростить динамическую миграцию, далее требуется настроить общие тома кластера Cluster Shared Volumes (CSV). В отличие от Server 2008 R2, в Server 2012 общие тома кластера включены по умолчанию. Однако все же требуется указать, какое хранилище следует использовать для общих томов кластера. Чтобы включить CSV на доступном диске, разверните узел Storage и выберите узел Disks. Затем выберите диск кластера, который нужно использовать как CSV, и щелкните ссылку Add to Cluster Shared Volumes на панели Actions диспетчера отказоустойчивого кластера (экран 9). Поле Assigned To этого диска кластера изменится с Available Storage на Cluster Shared Volume (общий том кластера), как показано на экране 9.

![Добавление CSV]()

Экран 9. Добавление CSV В это время диспетчер отказоустойчивого кластера настраивает хранилище диска кластера для CSV, в частности добавляет точку подключения в системном диске. В данном примере общие тома кластера включаются как на Cluster Disk 1, так и на Cluster Disk 3 с добавлением следующих точек подключения:

На данном этапе построен двухузловой кластер Server 2012 и включены общие тома кластера. Затем можно установить кластеризованные приложения или добавить в кластер роли. В данном случае кластер создан для виртуализации, поэтому добавляем роль виртуальной машины в кластер.

![Добавление роли виртуальной машины]()

Экран 10. Добавление роли виртуальной машины ![Выбор виртуальных машин, которым необходимо обеспечить высокую надежность]()

Экран 11. Выбор виртуальных машин, которым необходимо обеспечить высокую надежность Пример настройки хранилища iSCSI

Для отказоустойчивого кластера Windows Server 2012 требуется общее хранилище, которое может быть типа iSCSI, Serially Attached SCSI или Fibre Channel SAN. В данном отказоустойчивом кластере используется Channel SAN.

Сначала в сети iSCSI SAN были созданы три логических устройства LUN. Один LUN был создан для диска кворума кластера (520 Мбайт). Другой LUN предназначен для 10 виртуальных машин и имеет размер 375 Гбайт. Третий LUN выделен для небольшой тестовой виртуальной машины. Все три LUN представлены в формате NTFS.

После того, как были созданы LUN, была выполнена настройка iSCSI Initiator на обоих узлах Server 2012. Чтобы добавить цели iSCSI, был выбран iSCSI Initiator в меню Tools в диспетчере сервера. На вкладке Discovery я нажал кнопку Discover Portal. В результате появилось диалоговое окно Discover Portal, куда были введены IP-адрес (192.168.0.1) и порт iSCSI (3260) сети SAN.

Затем я перешел на вкладку Targets и нажал кнопку Connect. В диалоговом окне Connect To Target («Подключение к целевому серверу») я ввел целевое имя iSCSI SAN. Оно было получено из свойств SAN. Имя зависит от поставщика SAN, имени домена и имен созданных LUN. Помимо целевого имени я установил режим Add this connection to the list of Favorite Targets.

По завершении настройки iSCSI эти LUN появились на вкладке Targets iSCSI Initiator. Чтобы автоматически подключать LUN при запуске Server 2012, я убедился, что они перечислены на вкладке Favorite Targets, как показано на экране A.

![Настройка iSCSI Initiator]()

Экран A. Настройка iSCSI Initiator Наконец, были назначены буквенные обозначения устройствам LUN с помощью оснастки Disk Management консоли управления Microsoft (MMC). Я выбрал Q для диска кворума и W для диска, используемого для виртуальных машин и общих томов кластера (CSV). При назначении буквенных обозначений необходимо сначала назначить их на одном узле. Затем нужно перевести диски в автономный режим и сделать аналогичные назначения на втором узле. Результаты назначения букв дискам для одного узла приведены на экране B. При создании кластера диски будут показаны как доступное хранилище.

Читайте также:

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)