Что важнее видеокарта или оперативная память

Обновлено: 07.07.2024

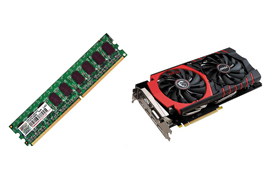

Видеопамять (или VRAM) — это такое же хранилище данных, как и оперативная память (DRAM) вашего компьютера. Много ли ее надо?

Вы могли заметить, что при настройке графики в играх интерфейс показывает, сколько видеопамяти потребуется при включении той и иной опции. Так вот, для комфортной игры с максимальным качеством отображения нам необходимо выяснить, сколько видеопамяти потребуется. Этим и займемся.

Что важно знать

- Видеопамять встроена в видеокарту и хранит графические данные, например игровые текстуры;

- Видеопамять нельзя менять так же просто, как оперативную память: если нужно больше VRAM — придется обновить видеокарту;

- Самое большое преимущество VRAM над обычной DRAM — скорость доступа. Поскольку чипы видеопамяти встроены прямо в видеокарту, графический процессор получает доступ к хранимой в ней информации быстрее, чем к SSD или жесткому диску.

Что произойдет, если видеопамяти все-таки не хватит?

Страшного — ничего, но впечатление от игры может быть подпорчено, особенно если вы решите поиграть в долгожданную и требовательную новинку. Ждите также проблем с производительностью и текстурами.

Что это значит?

Недостаточная емкость видеопамяти почти всегда означает проблемы с производительностью в играх. При серьезной нехватке VRAM начинает задействоваться более медленная DRAM (оперативная память ПК). В частности, это приводит к более низкой частоте кадров и незначительному притормаживанию.

Проблемы с текстурами — это, например, искажение изображения, задержки и разрывы кадров. Если у вас мало VRAM, вам придется выставлять в настройках игр более низкую детализацию текстур, чтобы при быстром перемещении по игровой карте вы не попадали в ситуацию, когда текстуры на определенном участке не успели полностью прогрузиться. В таких случаях вы вместо, допустим, домов будете видеть белые блоки, а вместо травы — пустое поле.

Сколько VRAM мне нужно для комфортной игры?

В 2021 году для комфортных игр в современные тайтлы нужно минимум 6 Гб видеопамяти. Но лучше всего рассматривать решения с 8 Гб, особенно если вы планируете играть на мониторе с разрешением 2K (1440p) или 4K (2160p). Так что когда вы задаете себе вопрос «Сколько VRAM мне вообще нужно?» — учитывайте следующие факторы:

1. Разрешение, в котором вы запускаете игры

Чем выше разрешение в игре, тем больше видеопамяти вам потребуется. Более высокое разрешение означает дополнительные пиксели, которые увеличивают размер текстуры и требуют больше памяти для ее хранения. Исходя из разрешения, требуемую емкость VRAM можно рассчитать:

- 2 Гб для разрешения 720p;

- 3 Гб для разрешения 900p;

- 4 Гб для разрешения 1080p;

- 6–8 Гб для разрешения 1440p;

- 8–12 Гб для разрешения 2160p.

Но не только разрешение изображения влияет на емкость памяти.

2. Сами игры, которые вы предпочитаете

Некоторые игры не только поддерживают высокие разрешения в 4K, но и в целом требуют больше видеопамяти. Как правило, это AAA-игры (в духе Call of Duty: Black Ops — Cold War) и игры с плохой оптимизацией (такое часто встречается при выходе новых игр, вспомним, к примеру, PUBG версии 2017 года).

Более качественная графика и количество отображаемых объектов на игровой карте также определяют, сколько памяти она использует. Например, игры с тяжелой графикой, такие как «Ведьмак 3»: Control и Shadow of the Tomb Raider требуют намного больше памяти, чем простые игры, не особо ориентированные на графику, такие как League of Legends и Counter-Strike: Global Offensive.

3. Использование графических модификаций

Иногда использование сторонних модов или графических надстроек может привести к увеличению использования видеопамяти до гораздо больших объемов, чем обычно. Это связано с тем, что некоторые моды добавляют в игры текстуры высокого разрешения (например, в The Elder Scrolls V: Skyrim или Fallout 76). Если использование модов — ваш предпочтительный способ игры, то вам, вероятно, следует рассматривать видеокарты с 6 Гб VRAM и более.

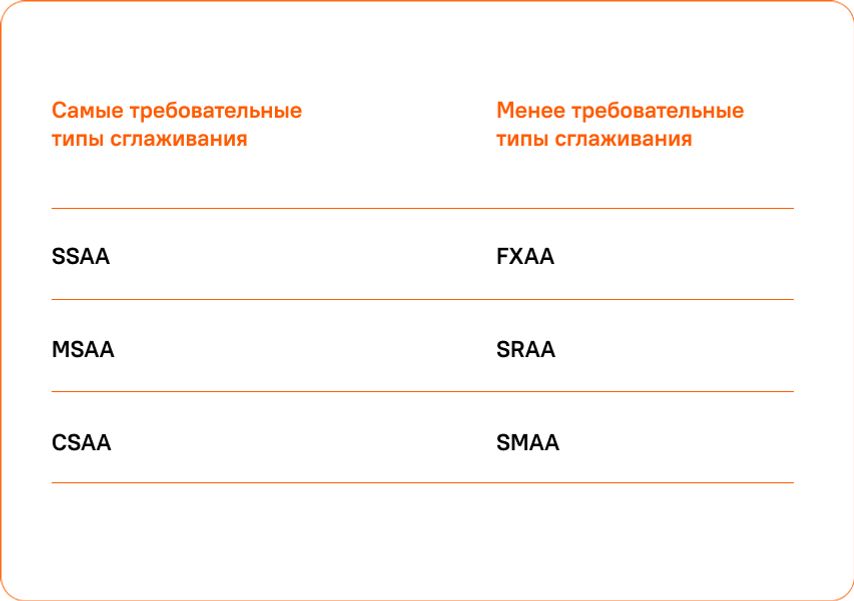

4. Сглаживание очертаний и контуров

Для сглаживания краев объектов и устранения эффекта лесенки в играх используется функция Anti-Aliasing. Чем сильнее сглаживание, тем приятнее получается картинка, однако для этого требуется отрисовать больше пикселей. Поэтому когда этот параметр включен, потребление видеопамяти также увеличивается. Степень его усиления будет зависеть от используемого метода Anti-Aliasing. К наиболее распространенным из них относятся:

- SSAA — сглаживание всей сцены;

- FXAA — быстрое сглаживание;

- MSAA — сглаживание краев объектов;

- TXAA — метод сглаживания с применением blur-эффекта;

- CSAA — сглаживание по краям с учетом соседних пикселей.

5. Настройки параметров игры

Чем выше настройки вашей игры, тем больше данных требуется обработать вашему графическому процессору — и тем больше памяти он потребляет в результате. Поскольку верно и обратное, вы можете понизить настройки игры, чтобы уменьшить использование памяти.

Компромисс или новая видеокарта?

Многим игрокам с видеокартами пятилетней давности, мечтающим о новых играх, приходится снижать настройки графики таким образом, чтобы их игры работали плавно. Помните, что такие настройки, как сглаживание, уровень детализации и качество текстур, больше всего влияют на потребление VRAM (о чем мы и говорили выше).

Если подобные компромиссы вас не устраивают — воспользуйтесь нашим гайдом. В самом начале мы привели приблизительный расчет по части емкости видеопамяти, которая требуется для запуска современных игр с максимальным качеством графики, так что вы без труда определитесь с параметрами VRAM.

Дальше останется лишь выбрать на сайте «Ситилинка» модели видеокарт, удовлетворяющие вашим требованиям, и подобрать оптимальный по цене вариант.

Всем привет! Из сегодняшнего поста вы узнаете, что для игр важнее — процессор или видеокарта, или вообще оперативная память, как в компьютере взаимодействуют эти компоненты и есть ли вариант сэкономить при сборке игрового ПК. О том, какой нужен процессор для стрима, можно почитать тут.

Как работают игры на компьютере

Для современных геймеров в большинстве случаев под «игрой» подразумевается проект ААА класса, с реалистичной графикой, в которой кат-сцены по качеству прорисовок часто уже неотличимы от 3D мультфильмов. Казуалки типа «три в ряд» в этой статье рассматривать не будем.

Для них достаточно мощности интегрированного в процессор видеочипа, даже для самых «навороченных».

Любая игра — по сути, набор 3D объектов и текстур, которые взаимодействуют между собой благодаря движку, согласно физическим законам, которые прописаны разработчиками.

Почти всегда эти законы повторяют законы реального мира: брошенный объект падает на землю, при столкновении с преградой тело может деформироваться, вода принимает форму сосуда, который заполняет и т. д.

Все эти взаимодействия — траектория полета пули, шанс на нанесение критического урона, влияние уровня сопротивления объекта и все остальное, и просчитываются процессором. Промежуточные результаты обработки хранятся в оперативной памяти.

Соответственно, чем больше параметров нужно просчитывать, тем мощнее процессор потребуется.

Для примера: если персонаж сидит в засаде, выжидая противника, операций просчитывается на порядок меньше, чем в следующей сцене, в которой отважный герой в одиночку нападает на вооруженную колонну бронетехники.

А вот рендерит, то есть рисует картинку, как раз видеокарта. От ее мощности зависит качество графики. У бюджетных моделей это будет почти символическое отображение задумки разработчиков, а у топовых это уже настоящее кино. Можно долго спорить о том, что сегодня игры уже не те и кроме графики в них ничего не осталось — речь совсем не об этом.

ОЗУ для промежуточного хранения отрендеренных объектов графический адаптер не задействует. Он оборудован собственной видеопамятью, с которой GPU сообщается напрямую, минуя центральный процессор.

Что лучше для производительности и почему

Сразу оговорюсь, что такая постановка вопроса, как важность CPU и GPU для игр, немного некорректна. Важнее всего соблюсти баланс.

Слабый процессор попросту не раскроет весь потенциал видеокарты, так как не будет успевать обрабатывать всю поступающую информацию. Слабая видеокарта качественно не отрисует всю ту «движуху» на экране, которую просчитывает мощный процессор.

За исключением случаев, если вы ведете игровую трансляцию — тогда CPU можно использовать для программной потоковой обработки видеоряда.

И напоследок приведу эталонный пример излишней мощности — процессор серии Core i9 в связке с графическим адаптером RTX 2080. Несмотря на то, что это топовая видеокарта, для раскрытия ее потенциала вполне достаточно ЦП Core i7.

Падение ФПС на 1-2 пункта вы при этом невооруженным взглядом не заметите, но сможете сэкономить до 1000 долларов. Это же сколько хороших игр можно купить на такую сумму!

Также советую почитать «Компьютерные процессоры — что о них нужно знать» и «2 ядерный или 4 ядерный процессор: интересно, кто круче?». Буду признателен, если вы поделитесь этой публикацией в социальных сетях. До завтра!

Ещё 20-30 лет назад вопрос о том, брать или не брать видеокарту (она же – видеоадаптер, графический ускоритель) практически не стоял. В то время графический ускоритель всегда был отдельным устройством, устанавливавшимся в отдельный слот системной (материнской) платы. Но к началу XXI века началось массовое внедрение графических ускорителей, интегрированных в конструкцию материнской платы. Спустя какое-то время они перекочевали на центральный процессор – первоначально в виде отдельного видеоядра, а затем в виде полноценного видеопроцессора.

Во время своей работы встроенный графический ускоритель может использовать:

- Оперативную память (ОЗУ) компьютера (бюджетные модели, занимающие большую часть рынка).

- Отдельные чипы собственной ОЗУ, распаянные непосредственно на системной плате (ноутбуки, нетбуки, планшеты и т. п.).

- Гибридный вариант, когда графический ускоритель одновременно использует оба вышеуказанных вида оперативной памяти.

Таким образом, сегодня, вопрос о том, потратить ли деньги на видеокарту или больший объём оперативной памяти, весьма актуален.

Какие задачи выполняет оперативная память

Оперативная память, являясь частью общей системы компьютерной памяти, обеспечивает хранение машинного кода исполняемых программ, а также временное хранение входной, выходной и промежуточной информации, обрабатываемой центральным процессором. Она непосредственно влияет на быструю и стабильную работу компьютера (ЭВМ), если он используется:

- Для сложных и долговременных расчётов, построения математических моделей.

- Для обработки больших объёмов фотографий аудио и видеозаписей, их перекодировки и монтажа.

- Для работы с программами 3D-моделирования.

- Для случаев, когда необходимо одновременно держать большое количество разнородных программ в активном (открытом) состоянии.

Какие задачи выполняет видеокарта

Видеоадаптер – специальное устройство, предназначенное для преобразования графического образа, хранящегося в ОЗУ компьютера (или собственной ОЗУ адаптера), в формат сигналов, пригодный для передачи на экран монитора. Современные видеокарты, используя мощные графические процессоры, огромное количество шейдерных (универсальных) процессоров и высокоскоростную видеопамять производят дополнительную обработку графического образа, тем самым разгружая центральный процессор. С недавних пор появилась тенденция использования ресурсов графического процессора для вычислительных процессов не связанных с графическими задачами.

Общие функции оперативной памяти и видеокарты

- Как ОЗУ компьютера, так и ОЗУ видеоадаптера предназначены для ввода-вывода обрабатываемых данных, а также хранения промежуточных результатов работы центрального процессора и видеопроцессора.

- Оба вида ОЗУ относятся к энергозависимому типу памяти (DRAM), теряющему записанные данные при отключении питания.

- Оба устройства важны, когда требуется: перекодировка, монтаж и другие варианты обработки видеозаписей; работа с системами автоматизированного проектирования (САПР) при разработке сложных 3D-моделей (разработка дизайнов различных объектов, конструкции сложных машин, химических соединений и многого другого). создание и обработка 2D-дизайнов с большим количеством информации, мощной цветовой палитрой и высоким разрешением.

- При необходимости увеличения эффективности оба устройства могут быть подвергнуты разгону, что может дать прирост производительности в 5-30%.

- Как видеоадаптер (не интегрированный), так и ОЗУ стационарного компьютера (и ряда мобильных) устанавливаются в специальные слоты системной платы, благодаря чему возможны: замена на более производительную модель; установка дополнительных устройств аналогичного назначения (при условии наличия свободных слотов соответствующего типа, а также совместимости, зависящей от производителя, поколения и модели). При этом возникновение проблем с совместимостью более вероятно для видеокарт, чем для ОЗУ.

Различия оперативной памяти и видеокарты

- Для передачи информации к центральному процессору и обратно используют разные шины передачи данных.

- Используют разные виды разъёмов для подключения к системной плате.

- В пределах одного периода выпуска устройств видеоадаптеры обладают более скоростной оперативной памятью.

- Общий объём основной оперативной памяти, как правило, превышает объём видеопамяти установленного видеоадаптера.

- При установке платы оперативной памяти той же модели, обеспечивает увеличение максимальной производительности на 100%, а за счёт двухканального параллельного режима работы прирост производительности может возрасти даже до 200%. Установка видеоадаптера той же модели даст прирост производительности видеоподсистемы лишь на 50-80%.

- Основная оперативная память, по сути, является устройством для выполнения одной функции – хранения и передачи данных различного назначения. Видеоадаптер фактически является миниатюрным компьютером, который обладает собственным центральным (графическим) процессором, собственной оперативной памятью, набором универсальных процессоров (для вспомогательных расчётов), а также блоками формирования текстур и растеризации для вывода окончательного изображения.

- Платам основной оперативной памяти компьютера достаточно пассивного воздушного охлаждения с помощью простейших пластиковых радиаторов, являющихся внешней частью корпуса платы. В то же время видеокарта, в большинстве случаев, требует активного воздушного или жидкостного охлаждения, а также применения конструктивно сложных одноуровневых или многоуровневых радиаторов из алюминия и/или меди.

- Электропитание основной оперативной памяти компьютера осуществляется через разъём подключения к системной плате, через который происходит приём и передача информации. В большинстве случаев, для обеспечения питания видеоадаптера необходимо его подключение к отдельному разъёму на системной плате, а в ряде случаев, для мощных устройств, наличие более мощного блока питания с дополнительными разъёмами питания.

Обоснование выбора оперативной памяти или видеокарты

Подводя итог, можно предложить следующие рекомендации по выбору подходящего устройства:

В предыдущих статьях мы поговорили про мифы о процессорах, оперативной памяти и материнских платах, теперь же перейдем к видеокартам, которые уже давно стали обязательной частью любого компьютера.

Первый миф. Чем больше видеопамяти — тем быстрее видеокарта

Казалось бы, это логично — в более мощные видеокарты ставится больше памяти: так, GTX 1070 с 8 ГБ памяти быстрее, чем GTX 1060 с 6 ГБ, а GTX 1080 Ti с 11 ГБ быстрее GTX 1080 с 8 ГБ. Однако следует понимать, что видеопамять, конечно, важна, но зачастую различное ПО не использует всю имеющуюся у видеокарты память: так, в большинстве случаев GTX 1060 с 3 ГБ медленнее версии с 6 ГБ всего на 5-10%, и разница в основном идет из-за различного числа CUDA-ядер.

Но есть производители видеокарт, которые решили воспользоваться этим мифом в свою пользу: так, например, на рынке можно найти GT 740 с 4 ГБ GDDR5 памяти. Казалось бы — да у GTX 780 Ti, топовой видеокарты того поколения, всего 3 ГБ памяти — то есть GT 740, получается, лучше? Разумеется нет — на тех настройках графики, где используется столько памяти, эта видеокарта выдает слайд-шоу. Ну а если снизить уровень графики для повышения «играбельности», то окажется, что использовано от силы 1-2 ГБ памяти. Причем такие видеокарты встречаются и в текущих линейках — так, у AMD есть RX 550 с теми же 4 ГБ GDDR5 — с учетом того, что видеокарта выступает приблизительно на уровне GT 1030, очевидно, что использовать столько памяти она сможет в очень немногих задачах:

Так что не стоит судить о производительности видеокарты, опираясь только на объем видеопамяти.

Второй миф. Если видеокарте не хватит видеопамяти в игре, то обязательно будут фризы, вылеты и тому подобное

Опять же, это кажется логичным: если видеокарте памяти не хватило, взять ее больше неоткуда — значит, программы корректно работать не смогут. Однако на деле это, разумеется, не так — любая видеокарта имеет доступ к оперативной памяти, которой обычно куда больше, чем видеопамяти. Конечно, ОЗУ в разы медленнее, а время доступа к ней больше — это может вызвать проблемы с плавностью картинки, но только лишь в том случае, если собственной памяти видеокарте не хватает сильно: например, у нее 2-3 ГБ памяти, а игра требует 4-5 ГБ. Но если не хватает нескольких сотен мегабайт, то обычно это проблем не вызывает: GPU умеют динамически использовать доступные им ресурсы, и в ОЗУ они стараются хранить ту информацию, которая нужна редко или не требует мгновенного отклика.

Третий миф. От разгона видеокарты сгорают

При этом различные производители продают разогнанные с завода версии видеокарт. Разумеется, при разгоне видеокарта может повредиться — но только в том случае, если вы измените «физические» параметры, такие как напряжение. Изменение программных параметров, таких как частоты, никак на «железо» не влияет, так что максимум, что вы получите, это вылет видеодрайвера или BSOD от выставления слишком высокой частоты.

Четвертый миф. SLI/Crossfire увеличивают производительность и объем видеопамяти во столько раз, сколько видеокарт подключено

Насчет производительности это, скорее, не миф, а теоретический результат. Увы — на практике, хотя тому же SLI 20 лет, а Nvidia его использует больше 10 лет, в большинстве игр прирост или околонулевой, или вообще отрицательный. Лишь в единичных проектах можно получить прирост хотя бы 20-30% в сравнении с одной видеокартой, что, конечно, смешно, с учетом двукратного увеличения стоимости и серьезных требований к блоку питания. Что касается вычислительных задач, то тут все сложнее: так, профессиональный софт вполне может использовать несколько GPU эффективно, но это уже не домашнее применение.

Что касается видеопамяти, то тут все просто: при использовании DirectX 11 или ниже в видеопамять каждого используемого GPU записывается одинаковая информация, то есть у связки видеокарт будет по сути тот же объем памяти, что и у одиночной карты. А вот в API DirectX 12 есть возможность более эффективно использовать Split Frame Rendering, когда каждая видеокарта готовит свою часть кадра. В таком случае объемы видеопамяти суммируются — пусть и с оговорками.

Пятый миф. Профессиональные видеокарты лучше игровых

Миф идет от того, что профессиональные видеокарты (такие как Nvidia Quadro или AMD FirePro) стоят обычно сильно дороже пользовательских «игровых» видеокарт — а раз дороже, значит лучше. На практике вопрос только в том — в какой области лучше? С физической точки зрения большая часть профессиональных видеокарт имеют тот же GPU и тот же объем памяти, что и обычные игровые видеокарты, а разница идет только из-за других драйверов, которые больше заточены под профессиональное применение:

С учетом того, что эти драйвера под игры никто специально не адаптирует, то профессиональные видеокарты в играх зачастую будут несколько хуже аналогичных по производительности игровых GPU. С другой стороны, если мы будем сравнивать эти же видеокарты в различных CAD-ах или 3ds Max — перевес будет на стороне профессиональной графики, причем зачастую очень существенный. Так что ответ на миф таков: сравнивать эти видеокарты в лоб не имеет смысла, они «играют» и в разных ценовых сегментах, и в разных сценариях использования.

Шестой миф. Если видеокарта не раскрывается процессором — это плохо

Пожалуй, самый популярный миф, который гласит о том, что если видеокарта не занята на 100% — это плохо. С одной стороны, это кажется логичным: нагрузка ниже 100% означает, что видеокарта частично простаивает и вы недополучаете часть производительности. С другой стороны, многие забывают, что нагрузить GPU на 100% можно практически при любом процессоре. Как так? Очень просто: каждый процессор в каждой игре может подготовить для видеокарты лишь определенное количество кадров в секунду, и чем процессор мощнее — тем больше кадров он может подготовить. Соответственно, чтобы видеокарта была занята на 100%, она должна иметь возможность отрисовать меньше кадров в секунду, чем может дать ей процессор. Как это сделать? Да очень просто: поднять разрешение, поставить более высокие настройки графики, включить тяжелое сглаживание — и вуаля, GTX 1080 Ti в 5К на ультра-настройках графики «пыхтит», выдавая 15-20 кадров в секунду, а поставленный ей в пару двухядерный Intel Pentium едва ли нагружен на половину.

Легко можно получить и обратную ситуацию: взять ту же самую GTX 1080 Ti и запустить на ней игру в HD-разрешении с минимальными настройками графики — и тут даже Core i9-9900K не сможет подготовить для ней столько кадров в секунду, чтобы она была занята на 100%.

Так что тут можно сделать два вывода: во-первых, если видеокарта недогружена несильно, а итоговый fps вас устраивает — всегда можно еще немного увеличить настройки графики, чтобы получить 100% нагрузку на видеокарту с лучшей картинкой и при той же производительности. Во-вторых, собирайте сбалансированные сборки, дабы не было такого, что процессор занят на 100%, а fps в игре 20 кадров.

Восьмой миф. Если видеокарта не перегревается, то она работает на максимально возможной для нее частоте в рамках ее теплопакета

Увы — аналогия с процессорами тут не работает: если те действительно удерживают максимальные частоты в рамках TDP вплоть до температуры, с которой начинается троттлинг из-за перегрева, то видеокарты работают хитрее: так, у Nvidia есть технология GPU Boost, которая, с одной стороны, является аналогом Turbo Boost для процессоров — позволяет поднимать частоту выше базовой — а с другой стороны имеет больше ограничений.

Возьмем, для примера, GTX 1080 Ti. Она имеет родную частоту в 1480 МГц, а Boost — 1580. Но стоит нагрузить видеокарту, как частота может подскочить до 1800-1850 МГц — то есть выше Boost: это и есть работа технологии GPU Boost. Дальше — интереснее: критические температуры у видеокарт поколения Pascal составляют порядка 95 градусов — но уже при 85 можно заметить, что частоты снижаются ближе к уровню Boost. Почему так? Потому что Nvidia ввела еще одну опорную температуру, которую называет целевой: при ее достижении видеокарта старается ее не превышать, а для этого сбрасывает частоты. Так что если у вас мощная видеокарта, да и еще с референсным турбинным охлаждением — внимательно следите за температурами, ибо от них в прямом смысле зависит производительность.

Девятый миф. Видеокарты без дополнительного питания хуже аналогов с ним

В продаже можно встретить видеокарты уровня GTX 1050, 1050 Ti и AMD RX 550 без дополнительного питания — то есть, как в старые добрые времена, достаточно поставить их в слот PCIe и они готовы к работе. При этом также есть версии 1050 и 1050 Ti с дополнительным питанием 6 pin, из-за чего некоторые пользователи делают вывод, что раз дополнительное питание есть — значит с ним видеокарты будут работать лучше.

На деле это не совсем так: слот PCIe способен дать видеокарте до 75 Вт, и этого вполне хватает, чтобы даже 1050 Ti работала на указанных на официальном сайте Nvidia частотах. Но если вы нацелены на разгон — да, тут питания от PCIe видеокарте может уже не хватить, так что дополнительные 6 pin от блока питания позволят достичь больших частот, однако разница в любом случае не превысит 10%.

Десятый миф. Не стоит ставить современные PCIe 3.0 видеокарты на старые платы со слотами PCIe 2.0 или 1.0

Все опять же логично — так, пропускная способность PCIe 2.0 x16 вдвое ниже, чем у 3.0 x16, а, значит, современные видеокарты через более старую шину PCIe будут работать медленнее. На деле это опять же не так — пропускная способность PCI Express 3.0 x16 даже для топовых современных видеокарт оказывается избыточной:

Хорошо видно, что разница между 3.0 x16 и 2.0 x16 составляет всего 1%, то есть погрешность, и даже если спуститься до PCIe 1.1 — то есть к материнским платам почти десятилетней давности — падение производительности оказывается всего лишь 6%. Так что вердикт тут прост — версия PCIe практически не влияет на производительность видеокарты, соответственно можно смело к Xeon с PCI Express 2.0 брать GTX 1080.

Одиннадцатый миф. Разгон видеопамяти не имеет смысла

Конечно, наибольший прирост дает разгон ядра видеокарты — тут прирост производительности близок к линейному (то есть увеличили частоту на 10% — получили прирост производительности на 10%). Однако не стоит сбрасывать со счетов видеопамять, особенно в слабых видеокартах: зачастую в них ставят те же чипы памяти, что и в более мощные решения, но при этом сильно снижают частоту. Это дает возможность ее достаточно сильно разогнать, зачастую на 20-40%, что может прибавить к общей производительности графики еще 10-15% — для слабых видеокарт это лишним, разумеется, не будет:

Двенадцатый миф. С выходом каждой новой линейки видеокарт производители урезают производительность старой

Достаточно популярный миф, основанный обычно на том, что на одних (обычно более старых) версиях драйверов видеокарта работает лучше, чем на других (обычно более новых). Разумеется, никакого реального основания он не имеет: если бы Nvidia и AMD на самом деле хотели заставить пользователей обновить видеокарты, они бы прекращали их поддержку как производители смартфонов на Android, через пару лет после выхода. Однако на деле даже решения 600-ой линейки от Nvidia, вышедшей более 6 лет назад, до сих пор получают новые драйвера наравне с более новыми видеокартами, причем со всеми программными «плюшками» типа DirectX 12.

Но почему тогда есть разница в производительности между драйверами? Потому что ничто в нашем мире не идеально, и какие-то драйвера, улучшая производительность в новых играх, могут испортить производительность в более старых или привести к различным ошибкам. Обычно через некоторые время выходят исправленные драйвера, и все возвращается на круги своя.

Читайте также: