Как установить файл robots txt на сайт

Обновлено: 04.07.2024

Файл robots.txt необходим для правильного сканирования и индексирования сайта роботами поисковых систем. Отсутствие файла или ошибки в нём могут негативно повлиять на ранжирование как отдельных веб-страниц, так и всего сайта.

Содержание

Видео по теме

Для чего нужен файл robots.txt?

Robots.txt позволяет запретить роботам сканировать определенные страницы, директории и отдельные файлы сайта.

Простейший пример содержания robots.txt, которое равнозначно отсутствию самого файла:

В то же время следующий код означает противоположный результат:

Управление сканированием

Robots.txt позволяет упорядочить процесс сканирования страниц и файлов сайта, что способствует:

- снижению нагрузки на сервер,

- ускорению попадания нужных страниц в поисковую выдачу,

- исключению попадания ненужных страниц в поисковую выдачу,

- индексированию главного зеркала сайта.

Управление индексированием

Запрет на сканирование в robots.txt не гарантирует исключение данных страниц из поисковой выдачи (индексной базы), т. к. правила в файле носят рекомендательный характер:

Настройки файла robots.txt являются указаниями, а не прямыми командами. Googlebot и большинство других поисковых роботов следуют инструкциям robots.txt, однако некоторые системы могут игнорировать их.

Справка Google

Кроме того, инструкции в robots.txt не могут отменить входящие с внешних ресурсов ссылки, благодаря которым поисковые роботы могут попасть на те страницы сайта, которые формально запрещены для сканирования в файле:

Нельзя использовать файл robots.txt, чтобы скрыть страницу из результатов Google Поиска. На нее могут ссылаться другие страницы, и она все равно будет проиндексирована.

Справка Google

Для того, чтобы запретить поисковым роботам индексировать страницы, следует применять мета-тег Robots. Однако это не касается изображений:

Файл robots.txt может использоваться для скрытия изображений из результатов поиска. Однако они будут доступны посетителям, и их все ещё можно будет открыть с других страниц.

Справка Google

Таким образом, robots.txt позволяет управлять сканированием сайта и индексированием изображений, но не исключает индексирование прочих файлов.

Как создать файл robots.txt?

При создании необходимо соблюдать ряд общих требований поисковых систем к данному файлу для того, чтобы поисковые роботы могли следовать его инструкциям.

Требования к файлу

У всех поисковых систем есть общие требования к robots.txt, которые необходимо учитывать при его создании:

- файл должен быть в формате txt ,

- файл должен называться robots (в нижнем регистре),

- файл должен быть доступен по URL-адресу домен/robots.txt ,

- при запросе файла сервер должен возвращать код 200 OK,

- размер файла не должен превышать 500 Кб.

При несоблюдении первых трех требований поисковые роботы просто не смогут найти файл из-за несоответствия формата/названия/URL-адреса файла правилам, установленным стандартом. Последние два пункта актуальны для роботов Яндекса:

Если файл не соответствует требованиям, сайт считается открытым для индексирования.

Яндекс.Помощь

Правильный robots.txt

Соблюдение вышеперечисленных требований позволяет обеспечить доступ к файлу поисковым роботам. Чтобы создать правильный robots.txt, необходимо хорошо изучить его синтаксис. В зависимости от сложности структуры сайта и его системы управления неправильно созданный файл может затруднить его сканирование и индексирование, а также способствовать увеличению нагрузки на сервер.

Процесс cоздания файла

Чтобы правильно сделать robots.txt для вашего сайта, следуйте следующему алгоритму действий:

- создайте простой текстовый файл формата txt ,

- переименуйте его в robots,

- внимательно изучите синтаксис стандарта,

- откройте созданный файл с помощью блокнота (или другого текстового редактора), файл (заполните с учетом особенностей сайта),

- осуществите проверку файла,

- при отсутствии ошибок, скопируйте созданный файл в корневую директорию сайта,

- проверьте его доступность по URL-адресу домен/robots.txt.

Генератор robots.txt

Синтаксис и директивы стандарта

Стандарт robots.txt отличается оригинальным синтаксисом. Существуют общие для всех роботов директивы (правила), а также директивы, понятные только роботам определенных поисковых систем.

Комментарии

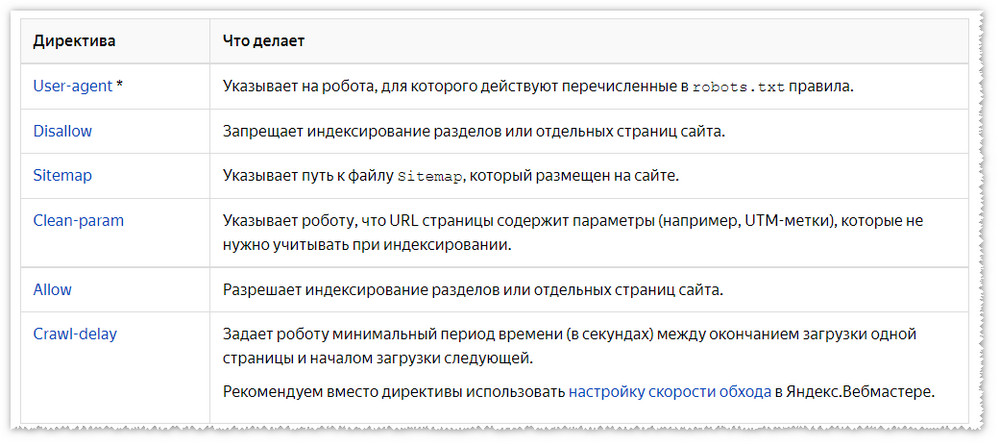

Стандартные директивы

Директивами для robots.txt называются правила, состоящие из названия и значения (параметра), идущего после знака двоеточия. Например:

Регистр символов в названиях директив не учитывается.

Для большинства директив стандарта в качестве значения применяется URL-префикс (часть URL-адреса). Например:

Регистр символов учитывается роботами при обработке URL-префиксов.

Директива User-agent

Правило User-agent указывает, для каких роботов составлены следующие под ним инструкции.

Значения User-agent

В качестве значения директивы User-agent указывается конкретный тип робота или символ * . Например:

Основные типы роботов, указываемые в User-agent :

Yandex Подразумевает всех роботов Яндекса. YandexBot Основной индексирующий робот Яндекса YandexImages Робот Яндекса, индексирующий изображения. YandexMedia Робот Яндекса, индексирующий видео и другие мультимедийные данные. Google Подразумевает всех роботов Google. Googlebot Основной индексирующий робот Google. Googlebot-Image Робот Google, индексирующий изображения.

Регистр символов в значениях директивы User-agent не учитывается.

Обработка User-agent

Чтобы указать, что нижеперечисленные инструкции составлены для всех типов роботов, в качестве значения директивы User-agent применяется символ * (звездочка). Например:

Перед каждым последующим набором правил для определённых роботов, которые начинаются с директивы User-agent , следует вставлять пустую строку.

При этом нельзя допускать наличия пустых строк между инструкциями для конкретных роботов, идущими после User-agent :

Обязательно следует помнить, что при указании инструкций для конкретного робота, остальные инструкции будут им игнорироваться:

Директива Disallow

Правило Disallow применяется для составления исключающих инструкций (запретов) для роботов. В качестве значения директивы указывается URL-префикс. Первый символ / (косая черта) задает начало относительного URL-адреса. Например:

Применение директивы Disallow без значения равносильно отсутствию правила:

Директива Allow

Правило Allow разрешает доступ и применяется для добавления исключений по отношению к правилам Disallow . Например:

При равных значениях приоритет имеет директива Allow:

Директива Sitemap

В качестве значения директивы Sitemap в указывается прямой (с указанием протокола) URL-адрес карты сайта:

Директива Sitemap является межсекционной и может размещаться в любом месте robots.txt. Удобнее всего размещать её в конце файла, отделяя пустой строкой.

Следует учитывать, что robots.txt является общедоступным, и благодаря директиве Sitemap злоумышленники могут получить доступ к новым страницам раньше поисковых роботов, что может повлечь за собой воровство контента.

Регулярные выражения

В robots.txt могут применяться специальные регулярные выражения в URL-префиксах с помощью символов * и $ .

Символ /

Символ / (косая черта) является разделителем URL-префиксов, отражая степень вложенности страниц. Важно понимать, что URL-префикс с символом / на конце и аналогичный префикс, но без косой черты, поисковые роботы могут воспринимать как разные страницы:

Символ *

Символ * (звездочка) предполагает любую последовательность символов. Он неявно приписывается к концу каждого URL-префикса директив Disallow и Allow :

Символ * может применяться в любом месте URL-префикса:

Символ $

Символ $ (знак доллара) применяется для отмены неявного символа * в окончаниях URL-префиксов:

Символ $ (доллар) не отменяет явный символ * в окончаниях URL-префиксов:

Директивы Яндекса

Роботы Яндекса способны понимать три специальных директивы:

- Host (устарела),

- Crawl-delay,

- Clean-param.

Директива Host

Директива Host является устаревшей и в настоящее время не учитывается. Вместо неё необходимо настраивать редирект на страницы главного зеркала.

Директива Crawl-delay

Если сервер сильно нагружен и не успевает отрабатывать запросы на загрузку, воспользуйтесь директивой Crawl-delay. Она позволяет задать поисковому роботу минимальный период времени (в секундах) между окончанием загрузки одной страницы и началом загрузки следующей.

Яндекс.Помощь

Правило Crawl-delay следует размещать в группу правил, которая начинается с директивы User-Agent , но после стандартных для всех роботов директив Disallow и Allow :

В качестве значений Crawl-delay могут использоваться дробные числа:

Директива Clean-param

Директива Clean-param помогает роботу Яндекса верно определить страницу для индексации, URL-адрес которой может содержать различные параметры, не влияющие на смысловое содержание страницы.

Если адреса страниц сайта содержат динамические параметры, которые не влияют на их содержимое (например: идентификаторы сессий, пользователей, рефереров и т. п.), вы можете описать их с помощью директивы Clean-param.

Яндекс.Помощь

В качестве значения правила Clean-param указывается параметр и URL-префикс адресов, для которых не следует учитывать данный параметр. Параметр и URL-префикс должны быть разделены пробелом:

Для указания 2-х и более незначительных параметров в одном правиле Clean-param применяется символ & :

Директива Clean-param может быть указана в любом месте robots.txt. Все указанные правила Clean-param будут учтены роботом Яндекса:

Настройка файла robots.txt

Правильная настройка файла позволит избежать ошибок при индексировании сайта, а также поможет поисковым роботам правильно его сканировать.

Как правильно настроить robots.txt?

Большинство сайтов, в зависимости от используемой CMS, имеет ряд страниц с одинаковым контентом, содержащих различные параметры в URL-адресах. Кроме того, содержание страниц по одинаковым URL-адресам иногда может меняться в зависимости от определённых условий. Такие страницы необходимо оградить от индексирования и сканирования. Чтобы облегчить работу поисковым роботам в отношении вашего сайта, нужно грамотно ограничить доступ к следующим страницам:

Как запретить индексацию в robots.txt?

На примерах разберем настройку запретов индексации.

Как закрыть сайт от индексации?

Чтобы запретить индексацию всего сайта применяется следующая настройка:

Как запретить индексацию страницы?

Чтобы запретить индексацию конкретной страницы нужно настроить файл следующим образом:

Как запретить индексацию папки?

Чтобы запретить индексацию папки с вложенными директориями и файлами применяются следующие настройки:

Запрет индексации каталога вместе с исходной страницей:

Как запретить индексацию страниц с параметрами?

Запрет индексации страниц с определёнными расширениями

Чтобы запретить индексацию всех страниц с конкретными расширениями, правила применяются в следующем виде:

Как разрешить индексацию в robots.txt?

Следующие условия означают, что сайт открыт для индексации и сканирования:

- если файл отсутствует или он пустой,

- если применяются указанные ниже настройки.

Разрешать индексирование отдельных файлов и папок приходится в исключительных случаях, когда родительская папка настроена на запрет:

Как указать Sitemap в robots.txt?

Чтобы добавить Sitemap (сообщить поисковым роботам о существовании файла карты сайта) применяется директива Sitemap :

Важное примечание

В качестве завершения напомним, что настройка запретов индексации в robots.txt не гарантируют непопадание данных страниц и каталогов в индекс, т. к. роботы могут попадать на закрытые в файле страницы по ссылкам с других ресурсов. Для того, чтобы полностью исключить возможность индексирования страниц и каталогов, следует использовать дополнительные настройки (например, мета-тег Robots ).

Как проверить файл robots.txt?

Для проверки на правильность можно воспользоваться специальными инструментами-анализаторами, которые нам любезно предоставляют ведущие поисковые системы рунета.

Анализ robots.txt онлайн в Яндекс

Проверить правильность файла можно с помощью инструмента сервиса Яндекс.Вебмастер. Авторизация не обязательна.

Преимущества анализатора Яндекса

Можно скопировать текст файла, не указывая ссылку на него. Это удобно, когда файл еще не размещен в интернете.

Если файл уже размещен в интернете, для проверки достаточно указать URL сайта.

Позволяет проверять доступность URL-адресов для роботов, в т. ч. относительных, если проверяемый сайт не указан.

Единственным значимым недостатком анализатора от Яндекса является необходимость авторизации.

Как проверить файл в Яндексе?

Проверять robots.txt в инструменте от Яндекса можно с указанием URL-адреса сайта, или просто введя код файла в текстовую область для проверки.

Проверка не размещённого в интернете файла

Рассмотрим процесс проверки robots.txt с помощью инструмента от ПС Яндекс без указания URL-адреса сайта:

Проверка файла для определённого сайта

Чтобы проверить размещённый в интернете для конкретного сайта robots.txt с помощью анализатора Яндекса, перейдём к вышеописанному пункту 2 и, вместо ввода кода в текстовую область, указываем доменное имя проверяемого сайта в соответствующее текстовое поле и жмем стрелочку напротив него:

После этого в тестовой области «Текст robots.txt» отобразится код файла для указанного сайта. Далее следует действовать, как описано выше.

Проверка доступности URL-адресов для роботов

С помощью анализатора можно проверить, какие URL-адреса попадают под запрет.

Анализ robots.txt онлайн в Google

Инструмент проверки правильности файлов robots.txt от Google менее удобен, т. к. требуется авторизация в сервисе Search Console и сайт, подтверждённый в данном сервисе.

Преимущества анализатора от Google

После добавления сайта файл проверяется автоматически. Отчет появляется на странице анализатора.

Нельзя вносить изменения в robots.txt, размещённый на сервере, но можно вносить правки в редакторе, скачивать файл и заменять его на сервере.

После обновления файла можно сообщить Google об этом.

Позволяет проверять доступность URL-адресов для роботов с возможностью выбора типа робота.

Недостатки анализатора от Google

Необходима регистрация в сервисе Google Search Console.

Нельзя проверить код, просто скопировав его, или загрузив файл с локального компьютера.

Нельзя проверить файл для сайта, не подтверждённого в Search Console.

Как проверить robots.txt в Google?

Рассмотрим процесс проверки файла в Search Console.

Проверка файла для определённого сайта

Требуется авторизация в поисковой системе Google. Если у Вас нет аккаунта, то необходимо его создать.

Выберите сайт, для которого Вы желаете проверить robots.txt. Если сайта нет – необходимо пройти процедуру добавления сайта.

Развернутся дополнительные элементы навигации.

Вы попадете на страницу соответствующего инструмента. Если для текущего сайта существует robots.txt, размещённый в корне сайта, то на странице будут отображаться:

- дата последней проверки файла,

- статус ответа сервера при запросе файла,

- размер файла,

- содержимое файла,

- ошибки и предупреждения.

Проверка доступности URL-адресов

- в нижней части страницы инструмента введите относительный URL страницы для проверки,

- выберите тип робота Google, от лица которого будет проводиться проверка,

- кликните Проверить ,

- статус отобразиться на месте кнопки Проверить .

Дополнительные возможности

-

Скачайте обновленный код.

Клик по соответствующей кнопке осуществит скачивание файла с кодом, который отображался в редакторе. Эта возможность позволяет осуществить правильную настройку robots.txt непосредственно в анализаторе Google, после чего скачать готовый файл и заменить его на сервере.

Клик по соответствующей кнопке осуществит переход к robots.txt текущего сайта. Позволяет проверить наличие файла на сайте.

Клик по соответствующей кнопке позволяет сообщить Google о том, что файл обновлен, и роботам следует обратить внимание на новые правила.

— это текстовый файл, который содержит параметры индексирования сайта для роботов поисковых систем.

Яндекс поддерживает стандарт исключений для роботов (Robots Exclusion Protocol) с расширенными возможностями.

При очередном обходе сайта робот Яндекса загружает файл robots.txt . Если при последнем обращении к файлу, страница или раздел сайта запрещены, робот не проиндексирует их.

Требования к файлу robots.txt

Размер файла не превышает 500 КБ.

Если файл не соответствует требованиям, сайт считается открытым для индексирования.

Яндекс поддерживает редирект с файла robots.txt , расположенного на одном сайте, на файл, который расположен на другом сайте. В этом случае учитываются директивы в файле, на который происходит перенаправление. Такой редирект может быть удобен при переезде сайта.

Рекомендации по наполнению файла

Яндекс поддерживает следующие директивы:

Задает роботу минимальный период времени (в секундах) между окончанием загрузки одной страницы и началом загрузки следующей.

Рекомендуем вместо директивы использовать настройку скорости обхода в Яндекс.Вебмастере.

Задает роботу минимальный период времени (в секундах) между окончанием загрузки одной страницы и началом загрузки следующей.

Рекомендуем вместо директивы использовать настройку скорости обхода в Яндекс.Вебмастере.

Наиболее часто вам могут понадобиться директивы Disallow, Sitemap и Clean-param. Например:

Роботы других поисковых систем и сервисов могут иначе интерпретировать директивы.

Примечание. Робот учитывает регистр в написании подстрок (имя или путь до файла, имя робота) и не учитывает регистр в названиях директив.Использование кириллицы

Для указания имен доменов используйте Punycode. Адреса страниц указывайте в кодировке, соответствующей кодировке текущей структуры сайта.

Пример файла robots.txt :

Как создать robots.txt

В текстовом редакторе создайте файл с именем robots.txt и укажите в нем нужные вам директивы.Пример файла. Данный файл разрешает индексирование всего сайта для всех поисковых систем.

Вопросы и ответы

Сайт или отдельные страницы запрещены в файле robots.txt, но продолжают отображаться в поискеКак правило, после установки запрета на индексирование каким-либо способом исключение страниц из поиска происходит в течение двух недель. Вы можете ускорить этот процесс.

Версия robots.txt из справки Яндекса

Чтобы создать правильный robots.txt, в первую очередь, необходимо знать директивы, которые поддерживает Яндекс.

Например, Disallow запрещает индексирование тех разделов сайта и отдельных страниц, которые вы укажите в этом файле. Allow, напротив, разрешает это индексирование. Реже используются директивы Clean-param и Crawl-delay.

Пример robots.txt с моего сайта на wordpress

Вы можете воспользоваться готовым примером robots.txt, который специально для моего блога составил приглашенный вебмастер. Ну и, в принципе, по запросу в Интернете можно найти другие примеры и применить именно их.

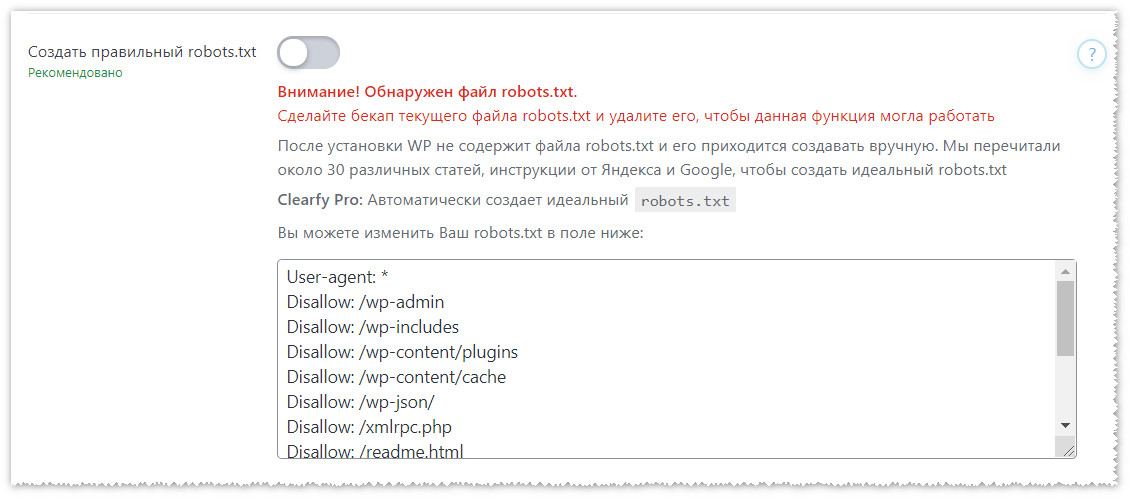

Готовый robots.txt, сгенерированный с помощью плагина Clearfy Pro

Самый простой и идеальный вариант, особенно для новичков, которые впервые решили создать сайт, это воспользоваться специальной опцией плагина Clearfy Pro.

Я считаю, что этот плагин должен стоять на всех сайтах, созданных на движке wordpress. О преимуществах плагина Clearfy Pro я уже писала на своем блоге.

Как установить на сайт текстовый файл robots.txt

Для ручной установки без плагина полностью скопируйте все команды из примера выше и вставьте в Блокнот. Чтобы данный файл работал корректно, необходимо заменить в примере название сайта на название вашей веб-площадки в следующих строках: Host и Sitemap.

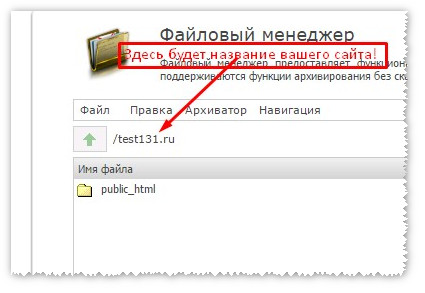

Последним этапом необходимо загрузить готовый документ в корневую папку сайта public_html.

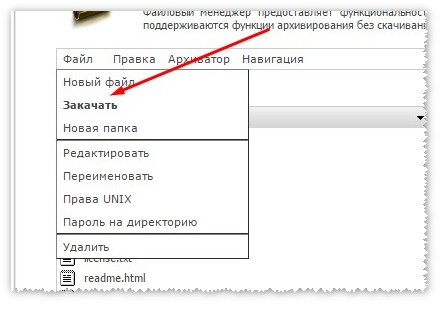

В консоли хостинга TimeWeb перейдите в папку Файловый менеджер.

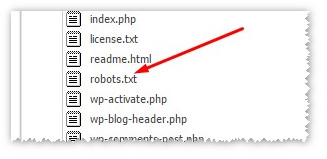

В ней найдите сайт, в который требуется установить текстовый robots.txt. Двойным щелчком вы попадете в папку public_html. Также откройте ее.

Вверху нажмите Файл — Закачать и выберите готовый robots.txt из папки на компьютере — Закачать.

Robots.txt установлен и лежит в папке public_html.

Чтобы проверить, правильно ли установлен данный файл, посмотрите короткий видеоурок.

Файл robots.txt — это текстовый файл, в котором содержаться инструкции для поисковых роботов, в частности каким роботам и какие страницы допускается сканировать, а какие нет. В данной статье рассмотрим, где можно найти robots.txt, как его редактировать и какие правила по его использовать в SEO-продвижении.

Где можно найти файл robots.txt и как его создать или редактировать

Чтобы проверить файл robots.txt сайта, следует добавить к домену «/robots.txt», примеры:

Как создать и редактировать robots.txt

Вручную

Данный файл всегда можно найти, подключившись к FTP сайта или в файлом редакторе хостинг-провайдера в корневой папке сайта (как правило, public_html):

Далее открываем сам файл и можно его редактировать.

Если его нет, то достаточно создать новый файл.

После вводим название документа и сохраняем.

Через модули/дополнения/плагины

Чтобы управлять данный файлом прямо в административной панели сайта следует установить дополнительный модуль:

Инструкция по работе с robots.txt

В первую очередь записывается User-Agent, указывая на то, к какому роботу идет обращение, например:

- User-agent: Yandex — для обращения к поисковому роботу Яндекса;

- User-agent: Googlebot — в случае с краулером Google;

- User-agent: YandexImages — при работе с ботом Яндекс.Картинок.

Полный список роботов Яндекс:

Синтаксис в robots.txt

Директивы в Robots.txt

Disallow

Disallow запрещает индексацию отдельной страницы или группы (в том числе всего сайта). Чаще всего используется для того, чтобы скрыть технические страницы, динамические или временные страницы.

Важно! Следует понимать, что регистр при использовании правил имеет значение, например, Disallow: /Category1/ не запрещает посещение страницы /category1/.

Allow

Директива Allow указывает на то, что роботу можно сканировать содержимое страницы/раздела, как правило, используется, когда в полностью закрытом разделе, нужно дать доступ к определенному документу.

Sitemap

Директива Sitemap указывает на карту сайта, которая используется в SEO для вывода списка URL, которые нужно проиндексировать в первую очередь.

Важно понимать, что в отличие от стандартных директив у нее есть особенности в записи:

- Следует указывать полный URL, когда относительный адрес использовать запрещено;

- На нее не распространяются остальные правила в файле robots.txt;

- XML-карта сайта должна иметь в URL-адресе домен сайта.

Пример

Clean-param

Clean-param: s /forum/showthread.php

Clean-param: sid /index.php

Подробнее о данной директиве можно прочитать здесь:

Crawl-delay

Важно! Данная директива не поддерживается в Яндексе с 22 февраля 2019 года и в Google 1 сентября 2019 года, но работает с другими роботами. Настройки скорости скачивания можно найти в Яндекс.Вебмастер и Google Search Console.

Crawl-delay указывает временной интервал в секундах, в течение которого роботу разрешается делать только 1 сканирование. Как правило, необходима лишь в случаях, когда у сайта наблюдается большая нагрузка из-за сканирования.

Пример

Как проверить работу файла robots.txt

В Яндекс.Вебмастер

В Яндекс.Вебмастер в разделе «Инструменты→ Анализ robots.txt» можно увидеть используемый поисковиком свод правил и наличие ошибок в нем.

Также можно скачать другие версии файла или просто ознакомиться с ними.

Чуть ниже имеется инструмент, который дает возможно проверить сразу до 100 URL на возможность сканирования.

В нашем случае мы проверяем эти правила.

Как видим из примера все работает нормально.

Также если воспользоваться сервисом «Проверка ответа сервера» от Яндекса также будет указано, запрещен ли для сканирования документ при попытке обратиться к нему.

В Google Search Console

В случае с Google можно воспользоваться инструментом проверки Robots.txt, где потребуется в первую очередь выбрать нужный сайт.

Важно! Ресурсы-домены в этом случае выбирать нельзя.

Теперь мы видим:

- Сам файл;

- Кнопку, открывающую его;

- Симулятор для проверки сканирования.

Если в симуляторе ввести заблокированный URL, то можно увидеть правило, запрещающее сделать это и уведомление «Недоступен».

Читайте также: